أحدث تقرير عن أشباه الموصلات من Morgan Stanley: دورة قوة الحوسبة للذكاء الاصطناعي تنتشر نحو التخزين والتغليف

في 5 مارس 2026، أصدرت Morgan Stanley تقرير أبحاث لصناعة أشباه الموصلات الآسيوية:

"Greater China Semiconductors – Bullish on Cloud, Memory and Optical Outlook; Accumulating Ahead of GTC".

يرى التقرير أن المحرك الرئيسي لصناعة أشباه الموصلات في الوقت الحالي لا يزال يأتي من بناء البنية التحتية للذكاء الاصطناعي، لكن محور الاهتمام في السوق يتغير.

إذا كان تركيز دورة الذكاء الاصطناعي في 2023-2024 ينصب أساسًا على وحدات معالجة الرسومات (GPU)، فإنه ابتداءً من 2025-2026 سوف يبدأ الطلب على الذكاء الاصطناعي في التوسع إلى سلسلة صناعة أشباه الموصلات بشكل أوسع، بما في ذلك:

الذاكرة (Memory)

التغليف المتقدم (Advanced Packaging)

شرائح ASIC المخصصة

شبكات مراكز البيانات

خلصت Morgan Stanley إلى:

الاستثمار في الطاقة الحسابية للذكاء الاصطناعي لا يزال في مرحلة التوسع، وصناعة أشباه الموصلات تدخل دورة طلب هيكلية جديدة.

أولاً: لا تزال نفقات رأس المال لمشغلي السحابة في توسع

الطلب الرئيسي على أشباه موصلات الذكاء الاصطناعي لا يزال يأتي من شركات الحوسبة السحابية.

وفقًا لتقديرات Morgan Stanley:

في الربع الرابع من 2025، نمت نفقات رأس المال لأكبر أربع شركات سحابة عالمية (Amazon، Microsoft، Google، Meta) بنسبة 64%على أساس سنوي.

إذا تم توسيع النطاق ليشمل أكبر عشر شركات سحابة في العالم، تتوقع Morgan Stanley:

أن تبلغ نفقات رأس المال العالمية للحوسبة السحابية في 2026 نحو 685 مليار دولار.

وفي توقعات أكثر طويلة الأجل، صرح الرئيس التنفيذي لشركة NVIDIA، Jensen Huang، بأن:

حجم الاستثمار في بنية الذكاء الاصطناعي التحتية العالمية قد يصل إلى تريليون دولار بحلول 2028.

هذا الاتجاه يعني أن:

بناء بنية الذكاء الاصطناعي التحتية لا يزال في مرحلة التوسع، وليس في ذروة السوق كما يُخشى.

ثانياً: استدلال الذكاء الاصطناعي يغير بنية الطلب على الذاكرة

تعتقد Morgan Stanley أن أحد أكثر الحلقات التي يساء تقديرها في هذه الدورة من الذكاء الاصطناعي هوالطلب على الذاكرة.

نماذج الاستدلال في الذكاء الاصطناعي تتطلب حفظ كمية كبيرة من البيانات السياقية (Context Memory)،

وهذا يدفع إلى ظهور طلب على بنية جديدة للذاكرة.

وقد قدم التقرير مفهومًا جديدًا:

ICMS (Inference Context Memory Storage)

أي نظام تخزين مخصص لسياق استدلال الذكاء الاصطناعي.

بحسب تقديرات Morgan Stanley:

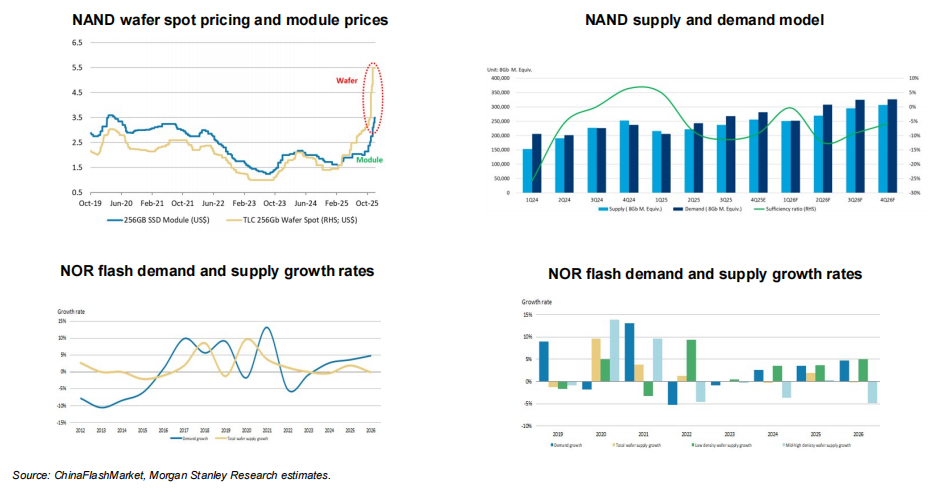

بحلول عام 2027، سيستهلك الطلب على الاستدلال للذكاء الاصطناعي 13% إضافية من الطلب العالمي على ذاكرة NAND.

وفي الوقت نفسه، قد يشهد سوق NOR Flash حالة من شح الإمداد.

ويرى التقرير أن:

قد يؤدي الطلب على الذكاء الاصطناعي إلى إعادة تنشيط دورة الصعود في صناعة الذاكرة.

ثالثاً: أصبح HBM عنق الزجاجة الرئيسي لقدرة الذكاء الاصطناعي الحوسبية

أحد العوامل الرئيسية في تحسين أداء رقائق الذكاء الاصطناعي هو الذاكرة ذات النطاق الترددي العالي (HBM).

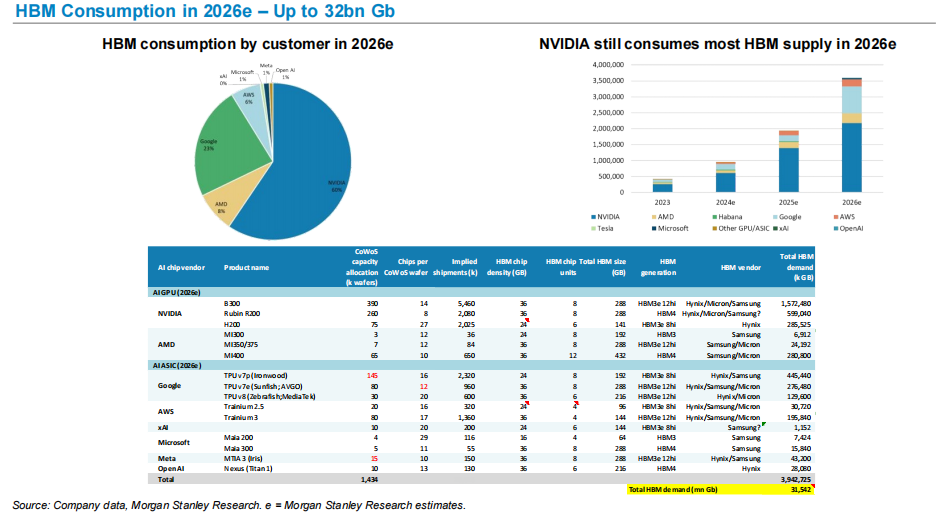

تتوقع Morgan Stanley:

أن يصل الطلب العالمي على HBM في 2026 إلى حوالي 32 مليار غيغا بت.

أما في بنية الطلب:

NVIDIA تظل المستهلك الأكبر لـ HBM.

الطلب على HBM من GPU الذكاء الاصطناعي وشرائح ASIC ينمو بسرعة، مما يجعل HBM مورداً رئيسياً في سلسلة تزويد طاقة الذكاء الاصطناعي.

ويوضح هذا الاتجاه أيضاً لماذا:

SK Hynix

Micron

Samsung

تبرز بشكل ملحوظ في دورة الذكاء الاصطناعي.

رابعاً: أصبح التغليف المتقدم عنق زجاجة في طاقة إنتاج رقائق الذكاء الاصطناعي

تتطلب وحدة معالجة الرسومات للذكاء الاصطناعي ليس فقط عملية تصنيع متقدمة، بل تعتمد أيضاً بشكل كبير على التغليف المتقدم.

تتوقع Morgan Stanley:

قدرة TSMC على التغليف المتقدم CoWoS قد تتوسع إلى 125 ألف شريحة في الشهر بحلول عام 2026.

ويأتي الطلب بشكل رئيسي من:

NVIDIA

AMD

الشرائح المملوكة للشركات السحابية الكبرى للذكاء الاصطناعي

وبالتالي أصبح التغليف المتقدم عنق زجاجة مهم في سلسلة تزويد رقائق الذكاء الاصطناعي.

خامساً: صعود سريع لشرائح الذكاء الاصطناعي الخاصة (AI ASIC)

إلى جانب وحدات معالجة الرسومات، تطور شركات السحابة شرائح ذكاء اصطناعي خاصة بها على نطاق واسع.

ومن ضمن المشاريع الرئيسية حالياً:

Google TPU

Amazon Trainium

Microsoft Maia

Meta MTIA

تتوقع Morgan Stanley أن يشهد حجم شحنات AI ASIC نمواً مستمراً في السنوات القادمة.

على سبيل المثال:

سيستمر حجم شحن شرائح AWS Trainium في التحسن خلال السنوات القادمة.

وهذا يشير إلى أن سوق قوة الذكاء الاصطناعي ستتميز في المستقبل بـ:

تطور متوازي بين GPU و ASIC.

سادساً: البدائل الصينية لوحدات معالجة الرسومات للذكاء الاصطناعي تتقدم

شمل التقرير أيضاً توقعات لصناعة شرائح الذكاء الاصطناعي في الصين.

تتوقع Morgan Stanley أن:

معدل الاكتفاء الذاتي للصين في وحدات معالجة الرسومات سيرتفع من 34% في 2024 إلى 50% في 2027.

وفي الوقت نفسه، من المتوقع أن يصل حجم سوق سحابات الذكاء الاصطناعي في الصين بحلول 2027 إلى:

نحو 48 مليار دولار.

وهذا يعني أن سلسلة صناعة قوة الذكاء الاصطناعي العالمية تشهد ظهور بنية إقليمية إلى حد ما.

فهمي الشخصي

إذا أردنا تلخيص التقرير بالكامل في جملة واحدة، فسيكون كالتالي:

دورة أشباه موصلات الذكاء الاصطناعي تنتشر الآن من "القدرة الحوسبية" إلى "كامل سلسلة التوريد".

في البداية تركز السوق على GPU.

لكن مع توسع حجم بنية الذكاء الاصطناعي التحتية، ينتشر الطلب إلى:

الذاكرة

التغليف المتقدم

شرائح الشبكة

ASIC المخصص

وهذا يعني أن:

الذكاء الاصطناعي لم يعد دورة شريحة منفردة، بل أصبح دورة طلب بنيوية لكامل سلسلة صناعة أشباه الموصلات.

أما بالنسبة لصناعة أشباه الموصلات،

التغيير الحقيقي ليس في الطلب على GPU، بل فيالبناء المستدام للبنية التحتية للقدرة الحوسبية.

إخلاء المسؤولية: يعكس محتوى هذه المقالة رأي المؤلف فقط ولا يمثل المنصة بأي صفة. لا يُقصد من هذه المقالة أن تكون بمثابة مرجع لاتخاذ قرارات الاستثمار.

You may also like

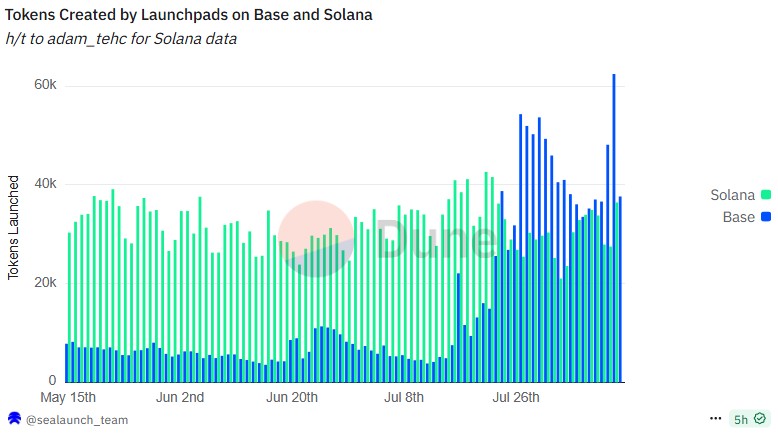

كيف ساهمت SocialFi وmemecoins وAI في دفع Base إلى قمة تصنيف L2

سينثيا لوميس تدفع نحو إعفاء ضريبي للعملات الرقمية للاستخدام اليومي

رمز WAR يميز نفسه عن Western Asset Fund وسط تصاعد التداول الجيوسياسي للعملات الرقمية

الرسالة الحقيقية لـ Bitcoin ليست اللامركزية، بل التحرر