Meta stellt vier brandneue KI-Prozessoren vor und verschärft damit den Wettbewerb mit Nvidia und AMD

Meta stellt neue KI-Prozessoren vor

Meta (META) hat vier fortschrittliche KI-Chips eingeführt und erweitert damit die Produktreihe Meta Training and Inference Accelerator. Diese Maßnahme ist Teil der Strategie von Meta, sowohl kommerzielle GPUs von Nvidia (NVDA) und AMD (AMD) als auch eigene Hardware einzusetzen, um den wachsenden KI-Bedürfnissen gerecht zu werden und die Abhängigkeit von einem einzelnen Anbieter zu reduzieren.

Überblick über die neuen Chips von Meta

- MTIA 300

- MTIA 400

- MTIA 450

- MTIA 500

Jeder Chip wird für spezifische KI-Workloads innerhalb von Meta entwickelt, von Ranking- und Empfehlungssystemen bis hin zu Hochleistungs-Inferenzaufgaben.

MTIA 400: Generative KI und Skalierbarkeit

Der MTIA 400 ist für generative KI und Empfehlungssysteme optimiert. Meta betont, dass bis zu 72 dieser Chips in einem einzigen Server-Rack integriert werden können, was dem Design der NVL72-Racks von Nvidia und Helios-Racks von AMD ähnelt.

Meta hebt den MTIA 400 als seinen ersten Prozessor hervor, der sowohl Kosteneffizienz als auch Leistung bietet, die mit führenden kommerziellen Produkten konkurrieren kann, ohne jedoch zu spezifizieren, welche Konkurrenten gemeint sind – wahrscheinlich Nvidia und AMD.

Vor Kurzem hat Meta mehrjährige Vereinbarungen mit sowohl Nvidia als auch AMD für deren Chips abgeschlossen.

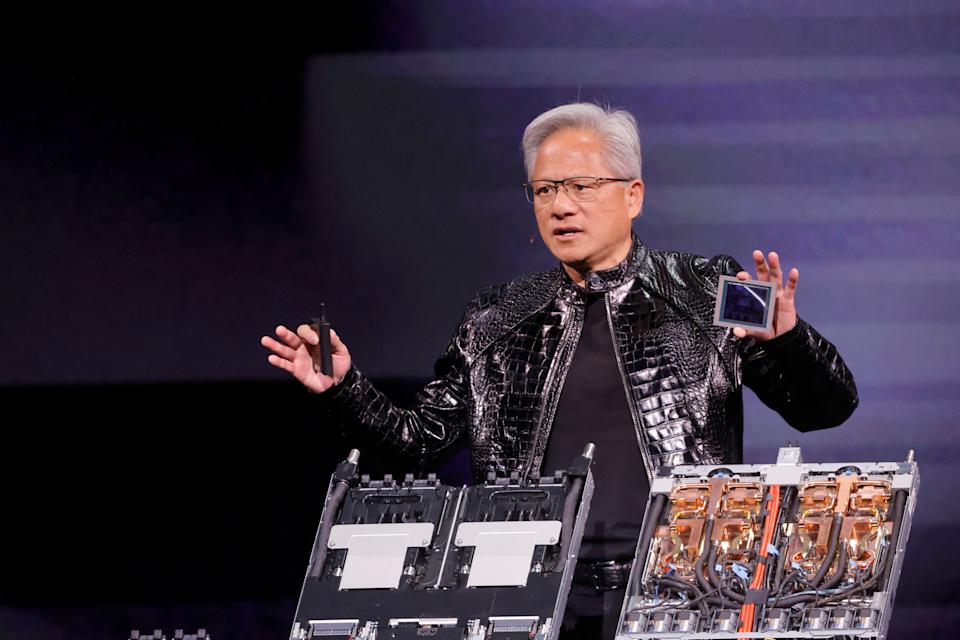

Nvidia-CEO Jensen Huang präsentiert eine Rubin-GPU während einer Keynote auf der CES 2026 in Las Vegas. (REUTERS/Steve Marcus)

MTIA 450 und MTIA 500: Verbesserte Speicher und Geschwindigkeit

Der MTIA 450 bietet im Vergleich zu seinem Vorgänger einen verbesserten Hochgeschwindigkeits-Speicher, während der MTIA 500 die Speicherkapazität und Geschwindigkeit noch weiter erhöht.

Meta hat bereits begonnen, einige dieser Chips einzusetzen und plant, den Rest 2026 und 2027 auszurollen. Alle Prozessoren verfügen über eine gemeinsame Infrastruktur, sodass Meta bei Bedarf nahtlos aufrüsten kann.

Branchentrends: Individuelle KI-Chips

Meta ist nicht allein bei der Entwicklung eigener Prozessoren für KI. Google (GOOG, GOOGL) und Amazon (AMZN) nutzen schon länger eigene Chips für KI-Training und Inferenz, und Microsoft (MSFT) hat kürzlich seinen Maia 200-Prozessor eingeführt.

Google und Amazon stellen zudem Anthropic Zugang zu ihren Chips für die Ausführung von KI-Modellen bereit. Laut The Information haben Google und Meta eine Vereinbarung in Milliardenhöhe getroffen, die es Meta ermöglicht, die Prozessoren von Google zu nutzen.

Auswirkungen auf Nvidia und AMD

Die Hinwendung zu individuellen Chips könnte Herausforderungen für Nvidia und AMD bedeuten. Laut Nvidia-CFO Colette Kress stammen über die Hälfte der Umsätze des Unternehmens im Bereich Rechenzentren von Hyperscale-Kunden.

Trotzdem verzeichnet Nvidia auch weiterhin Umsatzwachstum bei anderen Kunden.

Die großen Tech-Unternehmen bremsen ihre Investitionen in KI-Infrastruktur nicht. Im Jahr 2026 werden Amazon, Google, Meta und Microsoft voraussichtlich zusammen 650 Milliarden US-Dollar für Investitionen ausgeben, wobei der Großteil der Mittel in die KI-Entwicklung fließt.

Bleiben Sie auf dem Laufenden

Abonnieren Sie den Tech-Newsletter von Yahoo Finance für die neuesten Updates.

Hier finden Sie die neuesten Technologiemeldungen, die den Aktienmarkt beeinflussen

Lesen Sie aktuelle Finanz- und Wirtschaftsnachrichten von Yahoo Finance

Haftungsausschluss: Der Inhalt dieses Artikels gibt ausschließlich die Meinung des Autors wieder und repräsentiert nicht die Plattform in irgendeiner Form. Dieser Artikel ist nicht dazu gedacht, als Referenz für Investitionsentscheidungen zu dienen.

Das könnte Ihnen auch gefallen

XTER (Xterio) schwankt innerhalb von 24 Stunden um 42,0 %: Starkes Handelsvolumen löst heftige Preisschwankungen aus

TOWNS schwankt innerhalb von 24 Stunden um 42,7 %: Spekulative Kursschwankungen durch erhöhtes Handelsvolumen.