Después de ofender al Ministerio de Defensa, la colaboración entre Anthropic y Pal

Una orden del Pentágono no solo hizo que la unicornio de IA Anthropic perdiera un importante contrato militar, sino que también desencadenó un efecto dominó, obligando al gigante de datos "de uso oficial" del gobierno estadounidense, Palantir, a considerar un rompimiento total con Anthropic.

Según el último informe de The Information, durante más de un año, Anthropic ha prestado servicios al gobierno de Estados Unidos a través de Palantir. Los clientes de Palantir utilizan los modelos de Anthropic para identificar patrones en grandes cantidades de datos confidenciales y así apoyar la toma de decisiones. Sin embargo, a medida que el Departamento de Defensa ha colocado a Anthropic como un "riesgo de la cadena de suministro", esta relación de cooperación está en peligro.

Palantir, como contratista gubernamental preferido, obtuvo cerca de 4,500 millones de dólares en ingresos el año pasado, de los cuales aproximadamente el 42% provino de contratos con el gobierno estadounidense. Si Palantir deja de utilizar Anthropic en sus trabajos federales, cortará una fuente de ingresos para esta empresa emergente de IA. Aunque esta parte de las ventas aporta poco a los ingresos previstos de Anthropic, que podrían alcanzar hasta 18,000 millones de dólares este año, perder a Palantir como socio clave representa sin duda un golpe para el desarrollo de Anthropic en el mercado de grandes clientes.

Palantir podría tener que modificar su software; el CEO critica veladamente a Anthropic

Según medios que citaron a personas familiarizadas con el asunto, Palantir ofrece a sus clientes software personalizado y aplicaciones de IA, algunos de los cuales están especialmente diseñados para funcionar con el modelo Claude de Anthropic. Si Palantir prescinde de Claude, tendrá que modificar sus servicios, lo cual podría tomar varias semanas. Sin embargo, Palantir puede recurrir a otros proveedores de modelos de IA y continuar generando ingresos similares a partir de dichos contratos.

Alex Karp, CEO de Palantir, pareció criticar a Anthropic indirectamente durante una cumbre sobre tecnología de defensa celebrada en Washington el martes. Denunció que Silicon Valley está en contra de las fuerzas armadas estadounidenses y advirtió que las empresas de IA corren el riesgo de irritar tanto a liberales como a conservadores.

“Si Silicon Valley piensa que vamos a quitarle los empleos de oficina a todos... y además van a engañar a las fuerzas armadas, si no creen que esto provocará que nuestra tecnología se nacionalice, entonces están siendo ingenuos,” dijo Karp. “Ese es el rumbo de los acontecimientos.”

Anthropic planea tomar acciones legales e intenta tranquilizar a sus clientes

El pasado viernes, tras una disputa con Anthropic sobre las restricciones de uso de su IA por parte de las fuerzas armadas, el Secretario de Defensa, Pete Hegseth, afirmó haber instruido al gobierno para declarar a Anthropic como “riesgo en la cadena de suministro”.

El Pentágono exigió a Anthropic que autorice Claude para “todos los usos legales”; Anthropic se negó a llegar a un acuerdo, preocupada por la “vigilancia masiva” y las “armas totalmente autónomas”.

El Presidente de Estados Unidos, Trump, publicó el viernes pasado en Truth Social que entidades como el Departamento de Defensa, que utilizan productos de Anthropic, tendrán un “período de eliminación gradual de seis meses”.

Dario Amodei, CEO de Anthropic, argumentó que esta calificación “solo se extendería al uso de Claude como parte de un contrato con el Departamento de Guerra (nombre preferido por el gobierno de Trump para el Departamento de Defensa)”. Expertos legales señalan que Anthropic puede impugnar totalmente esta designación, en parte porque la legislación suele aplicarse a empresas extranjeras.

Según medios que citaron a fuentes cercanas, Anthropic señaló el viernes pasado que emprenderá acciones legales en tribunales contra la designación de riesgo en la cadena de suministro. Dado que la designación aún no es oficial, Anthropic todavía no ha presentado la demanda.

Anthropic intenta tranquilizar a clientes y socios comerciales, asegurando que la decisión del Departamento de Defensa (si se implementa) solo limitaría el uso de la tecnología de Anthropic por contratistas en trabajos militares estadounidenses, y no para cualquier compañía colaboradora con el gobierno federal.

Contratistas federales esperan guía del gobierno

Según medios que citaron a personas familiarizadas con los productos de Palantir, actualmente Palantir permite a sus clientes elegir qué modelo de IA usar, entre proveedores como Anthropic, OpenAI y Google, al analizar los datos recolectados en su plataforma. El Pentágono ha estado usando modelos de Anthropic alojados en Amazon Web Services (AWS), en conjunto con el software de Palantir.

Personas que conocen el uso de estos productos por parte del Pentágono indican que, además de los modelos de Anthropic, el Pentágono ya utiliza modelos de OpenAI, Google y otros proveedores a través del software de Palantir.

Empleados de empresas tecnológicas que hacen negocios con el gobierno mencionan que hasta esta semana, los contratistas federales esperan la guía del gobierno sobre cómo y si deben cortar los lazos con Anthropic para conservar sus contratos federales.

Disclaimer: The content of this article solely reflects the author's opinion and does not represent the platform in any capacity. This article is not intended to serve as a reference for making investment decisions.

You may also like

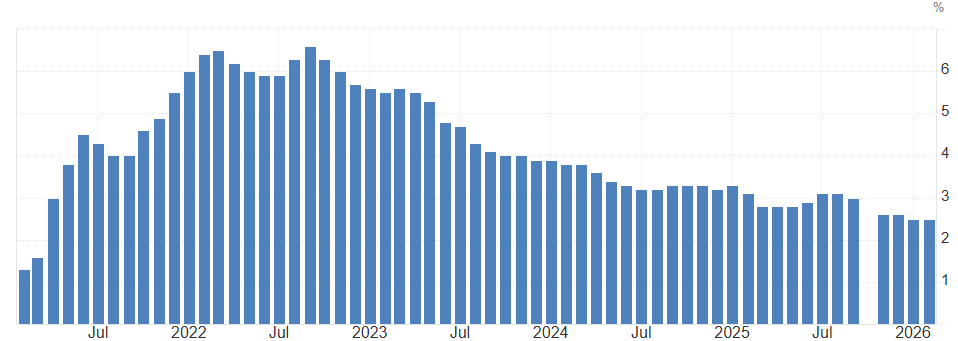

IPC de febrero: en línea con las expectativas, pero las preocupaciones persisten

Trending news

MoreGHO fluctúa un 80,9% en 24 horas: el precio alcanzó un máximo de 1,71 USD y luego retrocedió a 0,972 USD, sin que se reportaran públicamente las causas.

El IPC y las noticias de Irán sacuden los mercados globales: el Dow Jones cae más de 500 puntos, el precio del petróleo se dispara, el dólar se fortalece y bitcoin vuelve a los 70.000 dólares.