Meta presenta cuatro procesadores de IA adicionales, intensificando la competencia con Nvidia y AMD

Meta presenta nuevos procesadores de IA

Meta (META) ha presentado cuatro chips avanzados de IA bajo su línea Meta Training and Inference Accelerator (MTIA). Este movimiento forma parte de la estrategia de Meta de aprovechar tanto GPUs comerciales de Nvidia y AMD como su propio hardware, con el objetivo de cumplir con los requisitos de IA y al mismo tiempo reducir la dependencia de un solo proveedor.

Resumen de los chips MTIA

- MTIA 300

- MTIA 400

- MTIA 450

- MTIA 500

Cada chip está diseñado para abordar aspectos específicos de las operaciones de IA de Meta, desde sistemas de clasificación y recomendación hasta tareas sofisticadas de inferencia.

MTIA 400: IA generativa y escalabilidad

El MTIA 400 está diseñado para cargas de trabajo de IA generativa y de ranking/recomendación. Meta señala que hasta 72 de estos chips pueden integrarse en un solo rack de servidores, similar al enfoque visto en los racks NVL72 de Nvidia y Helios de AMD.

Meta destaca que el MTIA 400 es su primer procesador en ofrecer eficiencia de costos y desempeño comparable a los productos comerciales de más alto nivel, aunque no especifica a qué productos hace referencia. Nvidia y AMD son los principales competidores en este segmento.

Alianzas recientes

Meta ha firmado recientemente acuerdos a largo plazo tanto con Nvidia como con AMD para el suministro de chips, asegurando el acceso a varias generaciones de su tecnología.

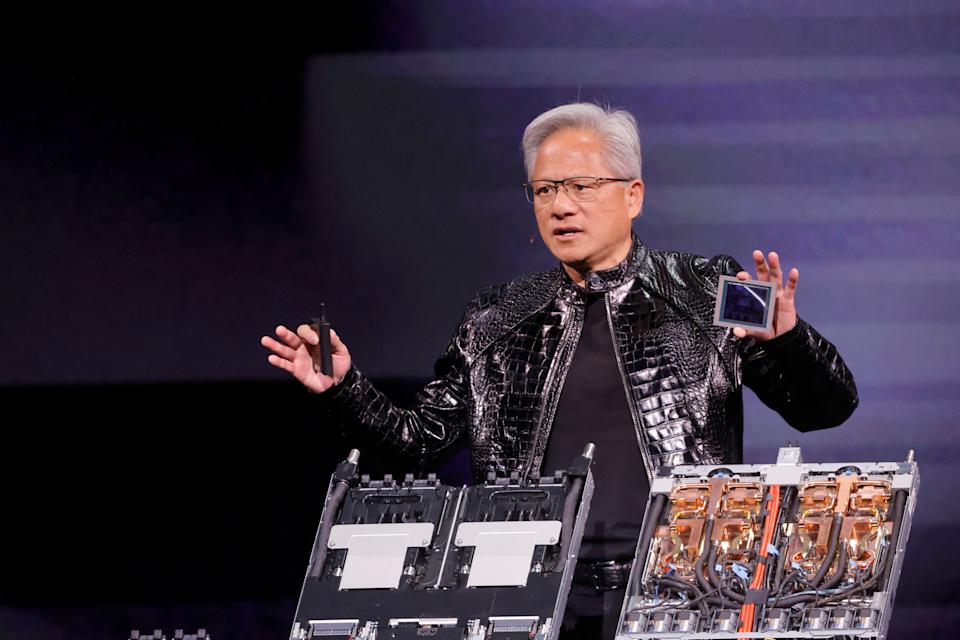

El CEO de Nvidia, Jensen Huang, presenta una GPU Rubin durante una conferencia magistral en el CES 2026 en Las Vegas. (REUTERS/Steve Marcus)

Avances con MTIA 450 y MTIA 500

El MTIA 450 ofrece una memoria de mayor ancho de banda en comparación con su predecesor, mientras que el MTIA 500 incrementa aún más la capacidad y velocidad de la memoria.

Planes de implementación

Meta ya ha comenzado a utilizar algunos de estos chips y planea implementar los modelos restantes en 2026 y 2027. Todos los procesadores comparten una infraestructura unificada, lo que permite actualizaciones sin inconvenientes según sea necesario.

Tendencias de la industria

Meta no es la única empresa que desarrolla chips personalizados de IA. Google y Amazon hace tiempo que utilizan sus propios procesadores para entrenamiento e inferencia de IA, mientras que Microsoft ha lanzado recientemente su chip Maia 200.

Google y Amazon también proveen sus chips a Anthropic para ejecutar modelos de IA. Según The Information, Google y Meta han firmado un acuerdo de miles de millones de dólares para que Meta utilice los procesadores de Google.

Impacto en Nvidia y AMD

Este cambio hacia chips personalizados presenta desafíos para Nvidia y AMD. La CFO de Nvidia, Colette Kress, afirmó recientemente que más de la mitad de los ingresos de la empresa provenientes de centros de datos son de clientes hyperscale.

A pesar de esto, Nvidia continúa viendo crecimiento en sus ingresos provenientes de otros clientes.

Los hyperscalers continúan invirtiendo en IA

Los principales proveedores de la nube no muestran señales de reducir sus inversiones en infraestructura de IA o en chips de terceros. Solo en 2026, se espera que Amazon, Google, Meta y Microsoft asignen en conjunto $650 mil millones en gastos de capital, con una parte significativa destinada al desarrollo de IA.

Suscribite al newsletter Week in Tech de Yahoo Finance para recibir las novedades.

Descargo de responsabilidad: El contenido de este artículo refleja únicamente la opinión del autor y no representa en modo alguno a la plataforma. Este artículo no se pretende servir de referencia para tomar decisiones de inversión.