Meta dévoile quatre nouveaux processeurs IA, intensifiant la concurrence avec Nvidia et AMD

Meta dévoile de nouveaux processeurs IA

Meta (META) a présenté quatre puces IA avancées dans le cadre de sa gamme Meta Training and Inference Accelerator (MTIA). Cette initiative s’inscrit dans la stratégie de Meta visant à exploiter à la fois les GPU commerciaux de Nvidia et AMD, ainsi que son propre matériel propriétaire, dans le but de répondre aux besoins en IA tout en réduisant sa dépendance envers un seul fournisseur.

Aperçu des puces MTIA

- MTIA 300

- MTIA 400

- MTIA 450

- MTIA 500

Chaque puce est conçue pour répondre à des aspects spécifiques des opérations IA de Meta, allant des systèmes de classement et de recommandation à des tâches d’inférence sophistiquées.

MTIA 400 : IA générative et évolutivité

La MTIA 400 est conçue pour les charges de travail en IA générative et pour le classement/recommandation. Meta précise que jusqu’à 72 de ces puces peuvent être intégrées dans une seule armoire de serveurs, à la manière de ce qui est observé dans les racks NVL72 de Nvidia et Helios d’AMD.

Meta souligne que la MTIA 400 est son premier processeur à offrir à la fois un rapport coût-efficacité et des performances comparables aux produits commerciaux de premier plan, sans toutefois spécifier les produits de référence. Nvidia et AMD sont les principaux concurrents dans ce domaine.

Partenariats récents

Meta a récemment conclu des accords à long terme avec Nvidia et AMD pour l’approvisionnement en puces, garantissant l'accès à plusieurs générations de leurs technologies.

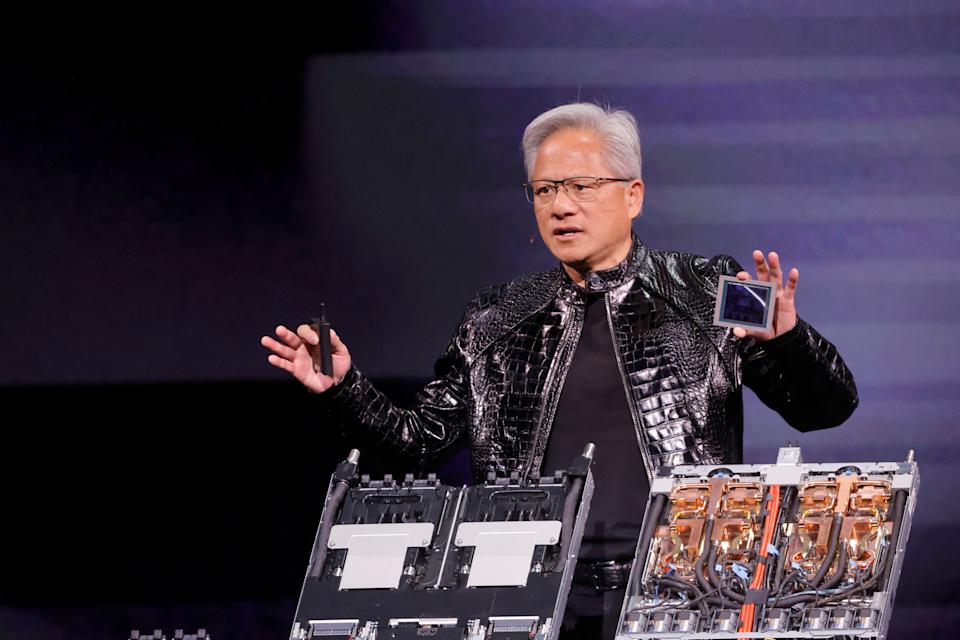

Le PDG de Nvidia, Jensen Huang, présente un GPU Rubin lors d'une keynote au CES 2026 à Las Vegas. (REUTERS/Steve Marcus)

Progrès avec MTIA 450 et MTIA 500

La MTIA 450 propose une mémoire à large bande passante améliorée par rapport à son prédécesseur, tandis que la MTIA 500 accroît encore la capacité et la vitesse de la mémoire.

Plans de déploiement

Meta a déjà commencé à utiliser certaines de ces puces et prévoit de déployer les autres modèles en 2026 et 2027. Tous les processeurs partagent une infrastructure unifiée, permettant des mises à niveau fluides en fonction des besoins.

Tendances du secteur

Meta n’est pas la seule à développer des puces IA personnalisées. Google et Amazon utilisent depuis longtemps leurs propres processeurs pour l’entraînement et l’inférence IA, tandis que Microsoft a récemment lancé sa puce Maia 200.

Google et Amazon fournissent également leurs puces à Anthropic pour l’exécution de modèles IA. Selon The Information, Google et Meta ont signé un accord de plusieurs milliards de dollars afin que Meta utilise les processeurs de Google.

Impact sur Nvidia et AMD

Cette évolution vers des puces sur mesure représente un défi pour Nvidia et AMD. La directrice financière de Nvidia, Colette Kress, a récemment déclaré que plus de la moitié du chiffre d’affaires des centres de données de la société provient des clients hyperscale.

Malgré cela, Nvidia continue d’enregistrer une croissance de ses revenus auprès d’autres clients.

Les hyperscalers continuent d’investir dans l’IA

Les principaux fournisseurs de cloud ne montrent aucun signe de réduction de leurs investissements dans les infrastructures IA ou dans les puces de fournisseurs tiers. Rien qu’en 2026, Amazon, Google, Meta et Microsoft devraient consacrer collectivement 650 milliards de dollars en dépenses d’investissement, une part significative étant dirigée vers le développement de l’IA.

Abonnez-vous à la newsletter Week in Tech de Yahoo Finance pour recevoir les dernières actualités.

Avertissement : le contenu de cet article reflète uniquement le point de vue de l'auteur et ne représente en aucun cas la plateforme. Cet article n'est pas destiné à servir de référence pour prendre des décisions d'investissement.