Dopo aver offeso il Ministero della Difesa, anche la collaborazione tra Anthropic e Palantir rischia di saltare

Un divieto imposto dal Pentagono non solo ha fatto perdere al unicorno dell’IA Anthropic un grande contratto militare, ma ha anche scatenato un effetto domino che ha costretto il gigante dei dati al servizio del governo statunitense, Palantir, a valutare di chiudere definitivamente i rapporti con la società.

Secondo quanto riportato recentemente da The Information, per oltre un anno Anthropic ha fornito servizi al governo degli Stati Uniti tramite Palantir. I clienti di Palantir utilizzano i modelli di Anthropic per identificare schemi in enormi quantità di dati riservati, aiutando così le decisioni operative. Tuttavia, con il Dipartimento della Difesa che ha classificato Anthropic come “rischio della catena di fornitura”, questa collaborazione è ora fortemente a rischio.

Palantir, fortemente apprezzato come appaltatore governativo, ha generato circa il 42% dei suoi ricavi dello scorso anno - pari a quasi 4,5 miliardi di dollari - tramite contratti con il governo statunitense. Se Palantir interrompesse l’uso della tecnologia Anthropic nei lavori federali, taglierebbe una fonte di reddito per questo startup dell’IA. Sebbene tale quota costituisca un contributo marginale negli 1,8 miliardi di dollari di fatturato attesi da Anthropic quest’anno, perdere un partner chiave come Palantir rappresenterebbe comunque un duro colpo all’espansione di Anthropic nel mercato dei grandi clienti.

Palantir potrebbe dover modificare il software, il CEO critica velatamente Anthropic

Secondo fonti citate dai media, Palantir fornisce ai suoi clienti software su misura e applicazioni di intelligenza artificiale, alcune delle quali sono progettate specificamente per lavorare con il modello Claude di Anthropic. Se si rinunciasse a Claude, Palantir dovrebbe modificare i propri servizi, un’attività che potrebbe richiedere alcune settimane. Tuttavia, Palantir può rivolgersi ad altri fornitori di modelli IA e mantenere ricavi simili da questi contratti.

Durante un vertice sulla tecnologia della difesa organizzato a Washington martedì, il CEO di Palantir, Alex Karp, ha criticato apparentemente Anthropic senza menzionarla direttamente. Ha accusato la Silicon Valley di opporsi alle forze armate americane, avvertendo le società di IA del rischio di alienarsi sia i liberali che i conservatori.

“Se la Silicon Valley pensa che ci porteremo via tutti i posti di lavoro da colletto bianco... e che vogliamo persino danneggiare l’esercito, se non pensate che questo porterà alla nazionalizzazione delle nostre tecnologie, allora siete degli idioti,” ha dichiarato Karp. “Questa è la direzione che sta prendendo la situazione.”

Anthropic valuta azioni legali e tenta di rassicurare i clienti

Venerdì scorso, dopo una disputa con Anthropic riguardo alle limitazioni sull’uso della loro IA da parte delle forze armate, il segretario alla Difesa Pete Hegseth ha dichiarato di aver ordinato al governo di designare Anthropic come “rischio della catena di fornitura”.

Il Pentagono ha richiesto ad Anthropic di autorizzare Claude per “tutti gli usi legali”, ma Anthropic ha rifiutato qualsiasi compromesso per timore di “sorveglianza di massa” e “armi completamente autonome”.

Il presidente degli Stati Uniti Trump, venerdì scorso su Truth Social, ha affermato che per agenzie come il Dipartimento della Difesa che utilizzano prodotti Anthropic, ci sarà un “periodo di eliminazione graduale di sei mesi”.

Il CEO di Anthropic, Dario Amodei, ha sostenuto che tale designazione “riguarda esclusivamente l’uso di Claude come parte di un contratto con il Dipartimento della Guerra” (definizione che l’amministrazione Trump predilige per il Dipartimento della Difesa). Secondo esperti legali, Anthropic può opporsi completamente a questa designazione, in parte perché tale normativa si applica di solito a società non statunitensi.

Stando a quanto riportato da fonti informate dai media, Anthropic ha dichiarato venerdì scorso che intende intraprendere azioni legali in tribunale contro la designazione come rischio della catena di fornitura. Dal momento che la misura non è ancora entrata formalmente in vigore, Anthropic non ha ancora avviato un’azione legale.

Anthropic sta tentando di rassicurare clienti e partner commerciali, specificando che la decisione del Dipartimento della Difesa (qualora venisse applicata) limiterebbe soltanto l’uso della tecnologia Anthropic da parte degli appaltatori governativi sui progetti militari statunitensi, e non influenzerebbe chiunque collabori semplicemente con il governo federale.

Appaltatori federali in attesa di indicazioni dal governo

Secondo fonti a conoscenza dei prodotti Palantir, attualmente l’azienda consente ai clienti di scegliere quale modello IA utilizzare tra i fornitori come Anthropic, OpenAI e Google durante l’analisi dei dati raccolti tramite la piattaforma. Il Pentagono utilizza da tempo i modelli Anthropic ospitati su Amazon Web Services (AWS), in combinazione con il software Palantir.

Persone informate su come il Pentagono utilizzi questi strumenti hanno riferito che, oltre ai modelli di Anthropic, il Dipartimento della Difesa impiega già anche quelli di OpenAI, Google e altri provider tramite il software Palantir.

Secondo dipendenti di società tecnologiche che fanno affari con il governo, fino a questa settimana gli appaltatori federali attendono una guida ufficiale sulle modalità e la necessità di interrompere o meno la collaborazione con Anthropic per mantenere i loro contratti governativi.

Esclusione di responsabilità: il contenuto di questo articolo riflette esclusivamente l’opinione dell’autore e non rappresenta in alcun modo la piattaforma. Questo articolo non deve essere utilizzato come riferimento per prendere decisioni di investimento.

Ti potrebbe interessare anche

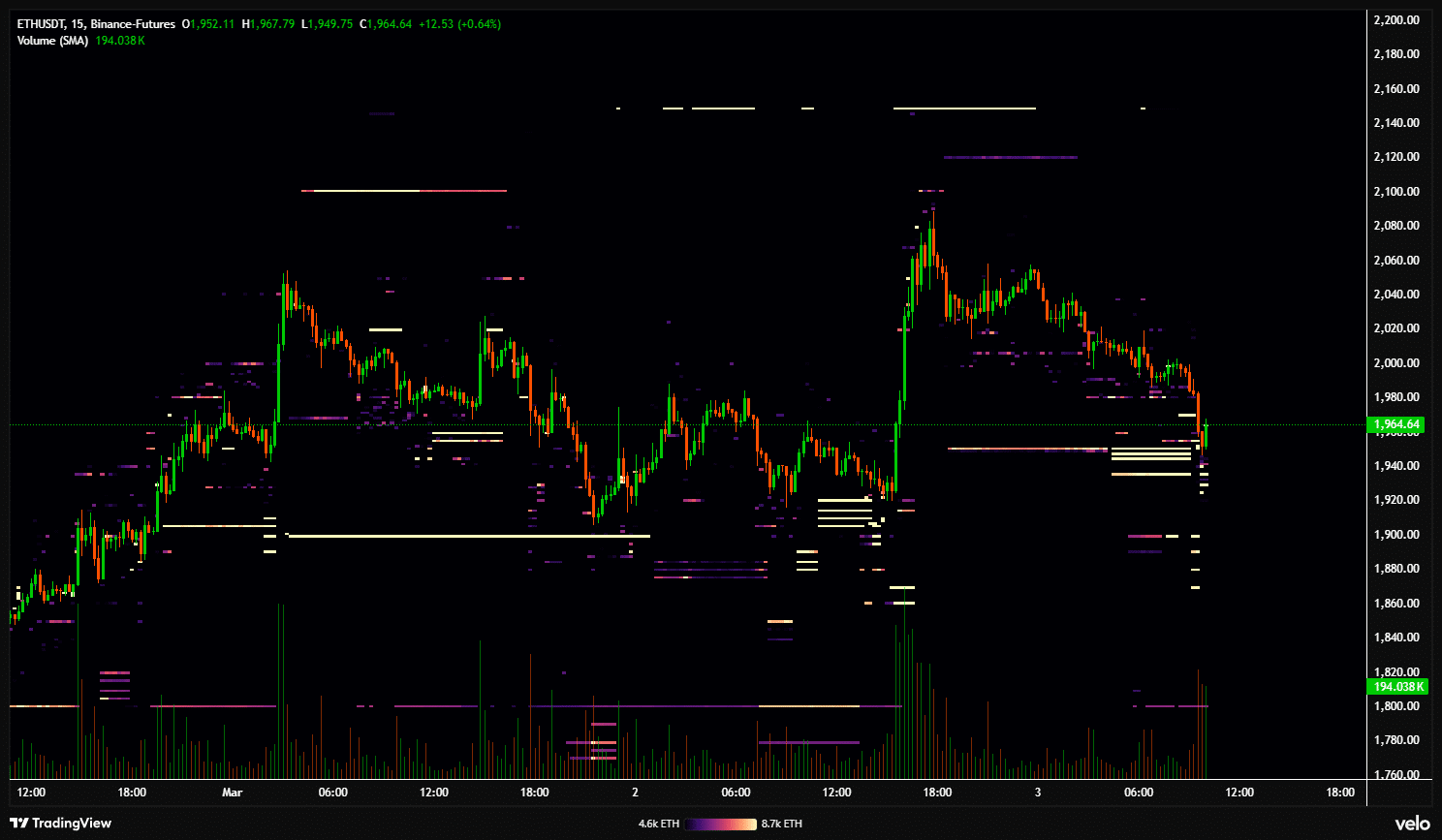

Interruzioni geopoliche nei mercati delle materie prime: valutazione degli effetti sul ciclo economico più ampio

TradFi adotterà le infrastrutture crypto 24/7 prima del previsto: Bitwise