I processori hanno riconquistato popolarità all'interno dei data center

Il panorama in evoluzione dei processori per data center

Negli ultimi anni, le unità di elaborazione grafica (GPU) hanno dominato il mercato tecnologico, con importanti cloud provider e aziende tech che hanno investito massicciamente in questi chip avanzati per alimentare le loro iniziative di intelligenza artificiale (AI).

Nel frattempo, le unità centrali di elaborazione (CPU)—componenti essenziali che gestiscono la maggior parte delle operazioni nei data center e dei servizi digitali quotidiani—hanno ricevuto meno attenzione mentre i riflettori si sono spostati sulle GPU.

Le CPU riconquistano importanza nell’era dell’AI

Questa tendenza sta iniziando a invertirsi. All’inizio di questo mese, Meta (META) e Nvidia (NVDA) hanno annunciato un’espansione significativa della loro partnership, con Nvidia che fornirà a Meta la sua più grande distribuzione di server Grace solo-CPU fino a ora.

Poco dopo, AMD ha rivelato un nuovo accordo con Meta, che prevede server equipaggiati con le CPU Venice e le imminenti Verano di AMD. Durante la call sugli utili di Intel (INTC) del 22 gennaio, il CEO Lip-Bu Tan ha sottolineato l’AI come un fattore chiave nell’aumento della domanda di CPU.

“La rapida crescita e diversificazione dei carichi di lavoro AI stanno mettendo sotto pressione sia l’hardware tradizionale che quello moderno, evidenziando il ruolo cruciale svolto dalle CPU nel mondo guidato dall’intelligenza artificiale di oggi,” ha osservato Tan.

Nonostante possa sembrare sorprendente che le CPU attirino nuovamente interesse nel pieno del boom dell’AI, l’ascesa dell’inferenza AI e degli agenti AI autonomi sta riportando le CPU al centro della scena.

CPU: La spina dorsale dell’informatica

Le CPU sono il cuore di quasi tutti i sistemi informatici. Da quando Amazon (AMZN) ha lanciato AWS nel 2006, le CPU hanno rappresentato le fondamenta dei data center su larga scala, rendendo possibili servizi come il ride-sharing, la collaborazione su documenti e la navigazione web.

Tuttavia, dopo che OpenAI (OPAI.PVT) ha lanciato ChatGPT alla fine del 2022, il settore ha spostato la sua attenzione sulle GPU, premiando aziende come Nvidia, che è diventata la società più preziosa al mondo specializzandosi nelle GPU per data center.

Le GPU, pur necessitando delle CPU per gestire il flusso dati, hanno portato a un calo degli investimenti nei server CPU stand-alone, poiché le organizzazioni hanno dato priorità all’infrastruttura GPU.

Rack di server presso il Digital Realty Innovation Lab di Ashburn, Virginia, 12 novembre 2025. (ANDREW CABALLERO-REYNOLDS / AFP via Getty Images)

Rack di server presso il Digital Realty Innovation Lab di Ashburn, Virginia, 12 novembre 2025. (ANDREW CABALLERO-REYNOLDS / AFP via Getty Images)“Abbiamo assistito a un chiaro spostamento degli investimenti verso l’infrastruttura GPU sia nell’addestramento sia nell’impiego su larga scala dei modelli AI,” ha dichiarato Ian Buck, VP di hyperscale e high-performance computing di Nvidia. “Questo ha portato a una stagnazione nel mercato delle CPU.”

Ad esempio, la divisione Data Center e AI di Intel ha registrato un calo del 5,2% anno su anno nel 2023, livelli invariati nel 2024, e un modesto recupero del 4,9% nel 2025, in un periodo in cui Intel stava vivendo una trasformazione più ampia.

Crescita delle GPU vs. Rinascita delle CPU

Al contrario, i ricavi della divisione Data Center di Nvidia sono schizzati alle stelle—+41% nel 2023, +217% nel 2024 e +142% nel 2025—con la domanda di GPU in forte ascesa presso gli hyperscaler per i carichi di lavoro AI.

Tuttavia, man mano che le aziende adottano modelli di AI più piccoli e agenti digitali autonomi, le CPU stanno tornando ad essere preferite. Questi agenti—bot semi o completamente autonomi che si occupano di task—stanno aumentando l’utilizzo delle CPU.

“Man mano che i clienti si spostano verso l’inferenza, usano modelli linguistici più piccoli e specializzati, che spesso funzionano in modo più efficiente sulle CPU,” ha spiegato Dan McNamara, vicepresidente senior e general manager del settore compute ed enterprise AI di AMD.

Gli agenti AI, che svolgono compiti come la navigazione web e la gestione dei file, incrementano ulteriormente l’utilizzo delle CPU.

“Immagina un agente AI che prenota un viaggio per te,” ha detto l’analista di Bernstein Stacy Rasgon. “La richiesta iniziale viene elaborata dal modello, ma la prenotazione effettiva avviene sui server della compagnia aerea, alimentati dalle CPU—non dalle GPU.”

Le CPU sono inoltre fondamentali per attività come data mining, personalizzazione e analisi contestuale che supportano i modelli AI alimentati da GPU.

“Tutti questi dati devono essere raccolti da vari database. Mentre la query di un utente può essere di qualche centinaio di parole, il processo sottostante coinvolge migliaia di parole e una gestione dati complessa, gestita interamente da schiere di CPU,” ha aggiunto Buck.

Il futuro mercato delle CPU per l’AI

L’analista di BofA Global Research Vivek Arya prevede che il ruolo crescente delle CPU nell’AI farà aumentare notevolmente i ricavi dei produttori di chip. Stima che il mercato delle CPU possa espandersi da 27 miliardi di dollari nel 2025 fino a 60 miliardi di dollari entro il 2030, con i server AI che rappresentano circa il 70% di quel mercato e i server non-AI il 19%.

Ciò non significa la fine dell’era delle GPU. Anzi, con l’aumento dei carichi di lavoro delle GPU, cresce anche il bisogno di CPU che li supportino.

“Non è un gioco a somma zero,” ha sottolineato McNamara. “La domanda di CPU sta crescendo, ma la crescita delle GPU non rallenta—semplicemente i carichi di lavoro complessivi aumentano.”

Iscriviti alla newsletter Week in Tech di Yahoo Finance. · yahoofinanceEsclusione di responsabilità: il contenuto di questo articolo riflette esclusivamente l’opinione dell’autore e non rappresenta in alcun modo la piattaforma. Questo articolo non deve essere utilizzato come riferimento per prendere decisioni di investimento.

Ti potrebbe interessare anche

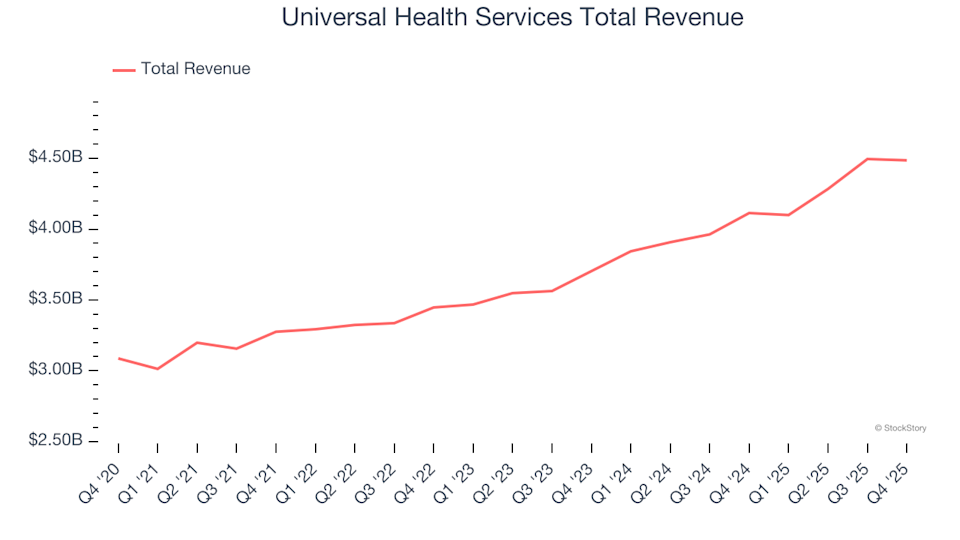

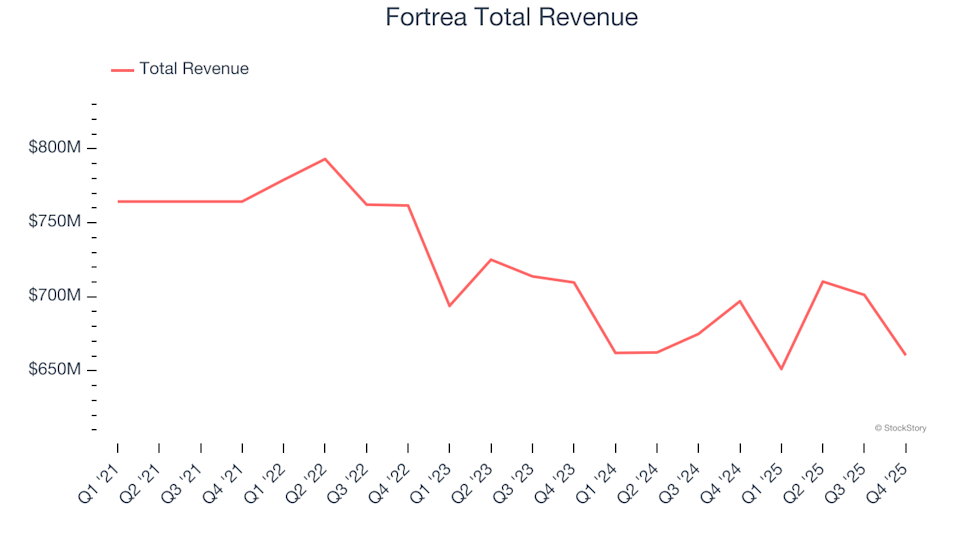

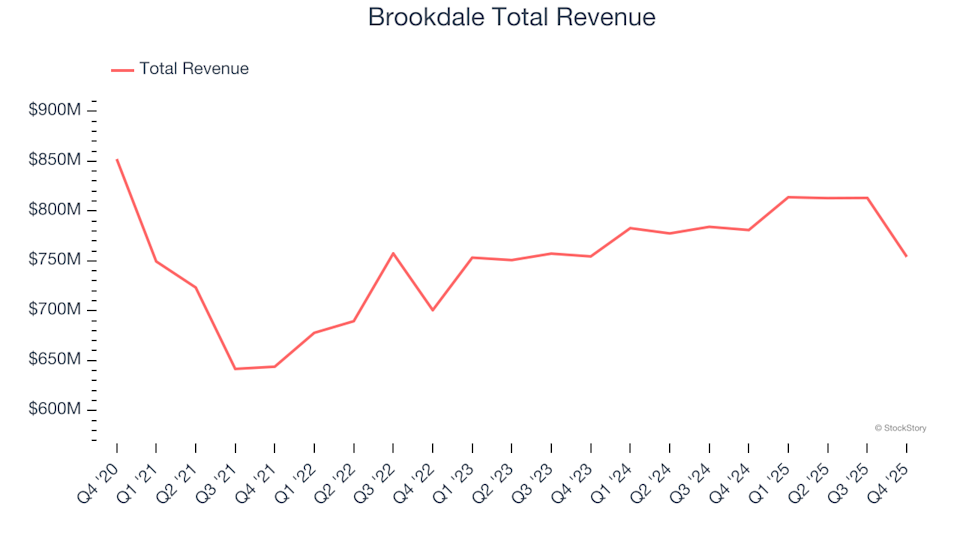

Riepilogo Q4 delle azioni delle catene ospedaliere: Universal Health Services (NYSE:UHS)