Najnowszy raport półprzewodnikowy Morgan Stanley: cykl mocy obliczeniowej AI rozszerza się na pamięć i pakowanie

5 marca 2026 r. Morgan Stanley opublikował raport dotyczący azjatyckiego sektora półprzewodników:

„Greater China Semiconductors – Bullish on Cloud, Memory and Optical Outlook; Accumulating Ahead of GTC”.

Raport wskazuje, że kluczowym czynnikiem napędzającym obecnie przemysł półprzewodników pozostaje rozwój infrastruktury sztucznej inteligencji, choć punkt ciężkości rynku ulega zmianie.

Jeśli cykl AI w latach 2023–2024 koncentrował się głównie na GPU, to od 2025–2026 zapotrzebowanie na AI zaczyna rozprzestrzeniać się na szerszy łańcuch dostaw półprzewodników, obejmując:

pamięć (Memory)

zaawansowane opakowania (Advanced Packaging)

dedykowane chipy ASIC

sieci centrów danych

Wnioski Morgan Stanley są następujące:

Inwestycje w moc obliczeniową AI nadal znajdują się w fazie ekspansji, a przemysł półprzewodników wkracza w nowy cykl strukturalnego zapotrzebowania.

1. Nakłady inwestycyjne firm chmurowych nadal rosną

Głównym źródłem zapotrzebowania na półprzewodniki AI pozostają dostawcy usług chmurowych.

Według danych Morgan Stanley:

W IV kwartale 2025 r. nakłady inwestycyjne czterech największych firm chmurowych na świecie (Amazon, Microsoft, Google, Meta) wzrosły rok do roku o 64%.

Jeśli rozszerzyć analizę na dziesięć największych firm chmurowych na świecie, Morgan Stanley szacuje:

W 2026 r. globalne nakłady inwestycyjne na chmurę mogą zbliżyć się do 685 mld USD.

W dłuższej perspektywie, CEO NVIDIA Jensen Huang przewidywał:

Na świecie inwestycje w infrastrukturę AI mogą przed 2028 r. osiągnąć 1 bilion dolarów.

Trend ten oznacza:

Rozwój infrastruktury AI nadal jest w fazie ekspansji, a nie – jak obawia się rynek – w fazie szczytowej.

2. AI inference zmienia strukturę zapotrzebowania na pamięć

Morgan Stanley uważa, że najbardziej niedocenianym elementem obecnego cyklu AI jestzapotrzebowanie na pamięć.

Modele AI inference muszą przechowywać dużą ilość danych kontekstowych (Context Memory),

co napędza nowy typ zapotrzebowania na architekturę pamięci.

W raporcie pojawia się koncepcja:

ICMS (Inference Context Memory Storage)

czyli system przechowywania kontekstu dedykowany dla inference AI.

Według obliczeń Morgan Stanley:

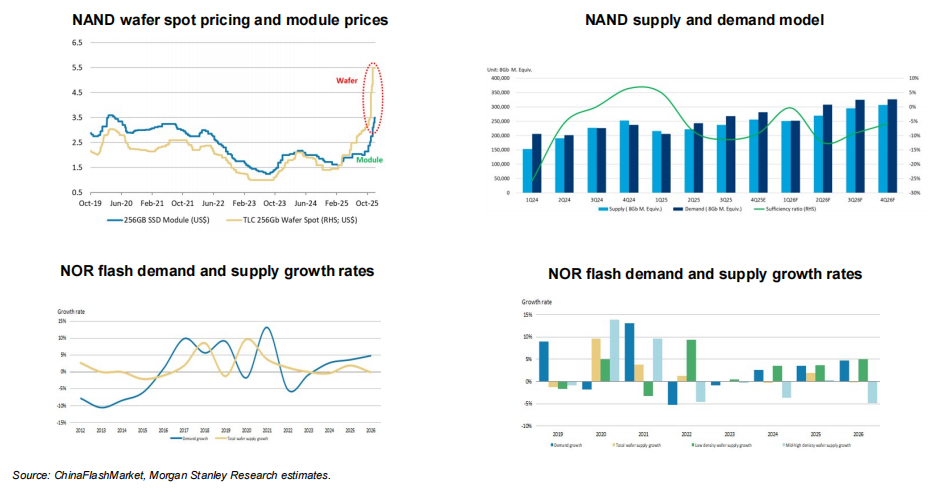

Do 2027 r. zapotrzebowanie na inference AI wygeneruje dodatkowo 13% globalnego popytu na pamięci NAND.

Jednocześnie rynek NOR Flash może wejść w fazę ograniczonej podaży.

Raport wskazuje:

Popyt na pamięć w sektorze AI może ponownie zapoczątkować wzrostowy cykl w branży pamięci.

3. HBM jako kluczowe wąskie gardło mocy obliczeniowej AI

Jednym z kluczowych warunków poprawy wydajności chipów AI jest pamięć o wysokiej przepustowości (HBM).

Morgan Stanley prognozuje:

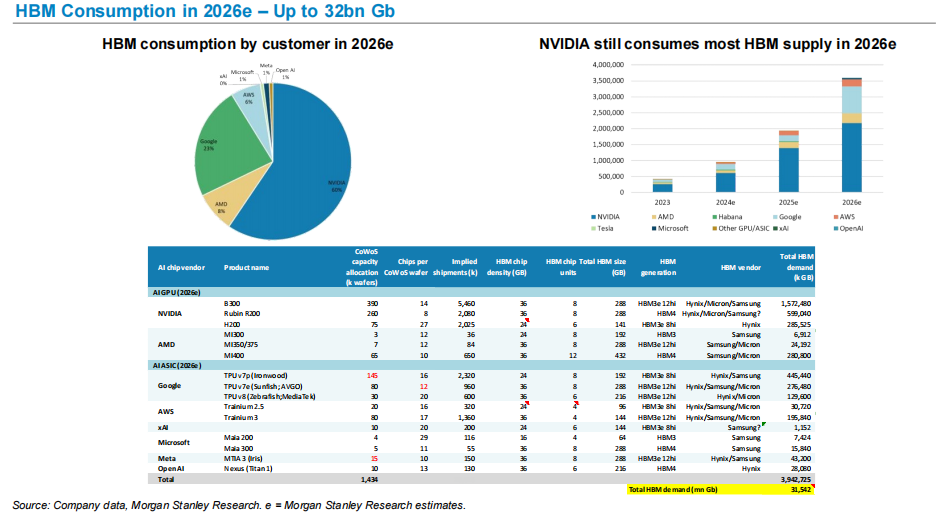

W 2026 r. globalne zapotrzebowanie na HBM może wynieść około 32 mld Gb.

W strukturze zapotrzebowania:

NVIDIA nadal pozostaje największym konsumentem HBM.

Zapotrzebowanie na HBM ze strony AI GPU i AI ASIC rośnie gwałtownie, czyniąc HBM kluczowym zasobem w łańcuchu dostaw mocy obliczeniowej AI.

Trend ten wyjaśnia także, dlaczego:

SK Hynix

Micron

Samsung

W cyklu AI są tak wyraźne.

4. Zaawansowane opakowania jako wąskie gardło produkcji chipów AI

GPU AI wymagają nie tylko zaawansowanej technologii, ale także bardzo zaawansowanego opakowania.

Morgan Stanley prognozuje:

Do 2026 r. TSMC CoWoS zaawansowana zdolność produkcji opakowań może zostać zwiększona do 125 tys. wafli miesięcznie.

Zapotrzebowanie pochodzi głównie od:

NVIDIA

AMD

własne chipy AI firm chmurowych

Zaawansowane opakowania stają się więc kluczowym wąskim gardłem w łańcuchu dostaw chipów AI.

5. AI ASIC szybko rośnie w siłę

Oprócz GPU, firmy chmurowe na dużą skalę rozwijają własne chipy AI.

Obecne kluczowe projekty to:

Google TPU

Amazon Trainium

Microsoft Maia

Meta MTIA

Morgan Stanley prognozuje, że w najbliższych latach dostawy AI ASIC będą nadal rosnąć.

Na przykład:

Seria chipów AWS Trainium będzie odnotowywać coraz większe dostawy w najbliższych latach.

To oznacza, że rynek mocy obliczeniowej AI będzie rozwijał się w kierunku:

Jednoczesnego rozwoju GPU + ASIC.

6. Zastępowanie GPU AI w Chinach postępuje

Raport obejmuje także prognozy dotyczące chińskiego sektora chipów AI.

Morgan Stanley prognozuje:

Chiński wskaźnik samowystarczalności GPU wzrośnie z 34% w 2024 r. do 50% w 2027 r.

Jednocześnie chiński rynek chmurowy AI osiągnie w 2027 r. wielkość:

około 48 mld USD.

Oznacza to, że globalny łańcuch branży mocy obliczeniowej AI zaczyna przyjmować strukturę regionalną.

Moje podsumowanie

Jeśli podsumować cały raport jednym zdaniem, to jest ono bardzo proste:

Cykl półprzewodników AI rozprzestrzenia się z „mocy obliczeniowej” na „cały łańcuch dostaw”.

W początkowej fazie rynku uwaga skupiała się na GPU.

Ale wraz z rozwojem infrastruktury AI popyt rozprzestrzenia się na:

pamięć

zaawansowane opakowania

chip sieciowy

dedykowane ASIC

To oznacza:

AI nie jest już po prostu jednym cyklem chipowym, lecz cyklem strukturalnego zapotrzebowania na cały łańcuch półprzewodników.

Dla przemysłu półprzewodników

prawdziwą zmianą nie jest wzrost zapotrzebowania na GPU, leczdługoterminowa budowa infrastruktury mocy obliczeniowej.

Zastrzeżenie: Treść tego artykułu odzwierciedla wyłącznie opinię autora i nie reprezentuje platformy w żadnym charakterze. Niniejszy artykuł nie ma służyć jako punkt odniesienia przy podejmowaniu decyzji inwestycyjnych.

Może Ci się również spodobać

Jak podwyżki cen obróciły się przeciwko Uber i Lyft: analiza behawioralna

Amerykańskie indeksy cen importu i eksportu – styczeń 2026