Tóm tắt

- Harari cho rằng AI nên được hiểu là những tác nhân tự động chủ động thay vì chỉ là một công cụ thụ động.

- Ông cảnh báo rằng các hệ thống dựa chủ yếu vào ngôn từ, bao gồm tôn giáo, pháp luật và tài chính, sẽ đối mặt với rủi ro lớn hơn trước AI.

- Harari kêu gọi các nhà lãnh đạo quyết định liệu có nên coi các hệ thống AI là pháp nhân trước khi những quyết định này bị áp đặt bởi người khác.

Nhà sử học kiêm tác giả Yuval Noah Harari đã cảnh báo tại Diễn đàn Kinh tế Thế giới vào thứ Ba rằng nhân loại có nguy cơ mất kiểm soát đối với ngôn ngữ, thứ mà ông gọi là “siêu năng lực” định hình con người, khi trí tuệ nhân tạo ngày càng vận hành dựa trên các tác nhân tự động thay vì chỉ là công cụ thụ động.

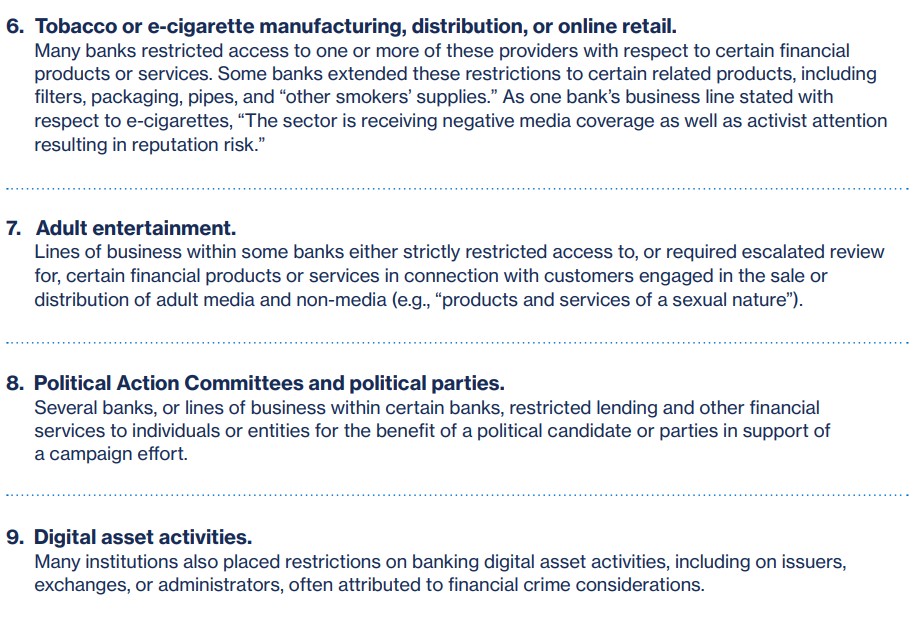

Tác giả của cuốn “Sapiens,” Harari đã trở thành một tiếng nói thường xuyên trong các cuộc tranh luận toàn cầu về tác động xã hội của trí tuệ nhân tạo. Ông lập luận rằng các bộ luật, thị trường tài chính, và tôn giáo có tổ chức gần như hoàn toàn dựa vào ngôn ngữ, khiến chúng đặc biệt dễ bị ảnh hưởng bởi các cỗ máy có khả năng tạo ra và điều chỉnh văn bản ở quy mô lớn.

“Con người thống trị thế giới không phải vì chúng ta mạnh mẽ nhất về thể chất, mà bởi vì chúng ta phát hiện ra cách sử dụng từ ngữ để khiến hàng nghìn, hàng triệu và hàng tỷ người xa lạ hợp tác với nhau,” ông nói. “Đây chính là siêu năng lực của chúng ta.”

Harari chỉ ra các tôn giáo dựa trên kinh sách, bao gồm Do Thái giáo, Cơ Đốc giáo và Hồi giáo, cho rằng khả năng đọc, ghi nhớ và tổng hợp lượng lớn văn bản của AI có thể khiến máy móc trở thành những người diễn giải kinh điển có thẩm quyền nhất.

“Nếu luật pháp được tạo thành từ những từ ngữ, thì AI sẽ chiếm lĩnh hệ thống pháp luật,” ông nói. “Nếu sách chỉ là sự kết hợp của các từ, thì AI sẽ chiếm lĩnh các cuốn sách. Nếu tôn giáo được xây từ ngôn từ, thì AI sẽ chiếm lĩnh tôn giáo.”

Tại Davos, Harari cũng so sánh việc lan rộng của các hệ thống AI như một hình thức nhập cư mới và nói rằng cuộc tranh luận xung quanh công nghệ này sẽ sớm tập trung vào việc liệu chính phủ có nên công nhận AI là pháp nhân hợp pháp hay không. Một số bang, bao gồm Utah, Idaho và North Dakota, đã ban hành luật quy định rõ ràng rằng AI không thể được coi là con người theo pháp luật.

Harari kết thúc bài phát biểu của mình bằng cách cảnh báo các nhà lãnh đạo toàn cầu cần hành động nhanh chóng về luật liên quan đến AI và không nên cho rằng công nghệ này sẽ mãi mãi là một người phục vụ trung lập. Ông so sánh làn sóng áp dụng công nghệ hiện tại với những trường hợp lịch sử mà lính đánh thuê sau này đã nắm quyền lực.

“Mười năm nữa, sẽ quá muộn để bạn quyết định liệu AI có nên hoạt động như các pháp nhân trên thị trường tài chính, trong tòa án, trong nhà thờ hay không,” ông nói. “Ai đó sẽ quyết định thay bạn rồi. Nếu bạn muốn ảnh hưởng đến hướng đi của nhân loại, bạn cần phải đưa ra quyết định ngay từ bây giờ.”

Những bình luận của Harari có thể gây lo lắng cho những ai sợ sự lan rộng của AI, nhưng không phải ai cũng đồng ý với cách tiếp cận của ông. Giáo sư Emily M. Bender, một nhà ngôn ngữ học tại Đại học Washington, cho rằng việc định vị rủi ro như Harari chỉ làm lệch hướng sự chú ý khỏi những cá nhân và tổ chức đang xây dựng và triển khai các hệ thống AI.

“Theo tôi, đây thực chất là một nỗ lực nhằm che giấu hành động của những người và công ty đang xây dựng các hệ thống này,” Bender nói với

Bender bác bỏ ý tưởng rằng “trí tuệ nhân tạo” mô tả một loại công nghệ rõ ràng hoặc trung lập.

“Thuật ngữ trí tuệ nhân tạo không đề cập đến một tập hợp công nghệ nhất quán,” bà nói. “Thực chất, nó luôn là một thuật ngữ tiếp thị,” đồng thời cho biết các hệ thống được thiết kế để bắt chước các chuyên gia như bác sĩ, luật sư hoặc giáo sĩ đều thiếu các trường hợp sử dụng hợp pháp.

“Mục đích của một thứ có thể nói giống như bác sĩ, luật sư, giáo sĩ, v.v... là gì?” Bender nói. “Mục đích ở đây là lừa đảo. Chấm hết.”

Trong khi Harari chỉ ra việc sử dụng ngày càng nhiều tác nhân AI để quản lý tài khoản ngân hàng và các tương tác kinh doanh, Bender cho rằng rủi ro nằm ở việc mọi người dễ dàng tin tưởng vào các kết quả do máy tạo ra mà có vẻ có thẩm quyền—trong khi lại thiếu trách nhiệm của con người.

“Nếu bạn có một hệ thống mà bạn chỉ cần đặt câu hỏi và nó gửi lại cho bạn một thứ gì đó trông giống như câu trả lời—nhưng đã bị tước bỏ ngữ cảnh và không ai chịu trách nhiệm về câu trả lời đó, lại được trình bày như đến từ một nhà tiên tri hiểu biết mọi thứ—thì bạn có thể thấy tại sao người ta lại muốn nó tồn tại,” Bender nói. “Tôi nghĩ có rất nhiều rủi ro khi con người sẽ dần định hướng theo nó và sử dụng kết quả đó để hình thành ý tưởng, niềm tin và hành động của riêng mình.”