Jensen Huang zieht sich frühzeitig zurück: Vor der großen CPO-Explosion treten optische Module in ein „Wettrüsten“ ein.

Quelle: US-Aktien Forschungsagentur

Im rasanten Aufstieg der Künstlichen Intelligenz konzentriert sich der Markt oft auf die Iteration der Rechenleistung der GPUs selbst, während das „Nervensystem“, das dieses riesige Rechenleistungsnetzwerk unterstützt, leicht übersehen wird.

Während alle noch über die Kapazitätsverteilung von H100 und B200 diskutierten, richtete Nvidia-Gründer Jensen Huang seine Aufmerksamkeit bereits auf die tiefere Infrastruktur – die optische Vernetzung.

Kürzlich berichtete der Markt, dass NVIDIA jeweils 2 Milliarden US-Dollar in die Optokommunikations-Giganten Lumentum und Coherent investiert und große Einkaufsverpflichtungen sowie zukünftige Kapazitätsrechte gesichert hat.

Dieser Schritt wirkt wie eine Finanzinvestition, ist tatsächlich aber eine „strategische Blockierung“ der Rechenleistungsinfrastruktur.

Dies markiert einen grundlegenden Wandel in der Wettbewerbslogik der KI-Wertschöpfungskette: Vom reinen Chip-Leistungswettbewerb hin zu einer kapitalbindenden und kapazitätssichernden Kontrolle der Kernlieferkette im upstream.

Optische Module, insbesondere die Co-Packaged Optics (CPO)-Technologie, stehen kurz vor einem enormen Durchbruch. Ein „Rüstungswettlauf“ rund um die optische Vernetzung hat bereits leise begonnen.

Keine Investition, sondern Kapazitätsbindung: NVIDIA

Ein Notfallplan beim „Optomodul-Mangel“

Um die volle Bedeutung von Nvidias Schritt zu verstehen, muss man die Lektionen aus den vergangenen zwei Jahren betrachten, in denen die Gewinnkurve von KI-Servern durch HBM (High Bandwidth Memory) zum Flaschenhals wurde.

In der Anfangsphase der KI-Explosion glaubte der Markt, dass die Kapazität der GPU-Produktion der Engpass sei. Mit dem Anstieg der Nachfrage verschob sich der eigentliche limitierende Faktor schnell auf HBM.

Die drei Speicher-Giganten (SK Hynix, Samsung, Micron) kontrollierten durch ihre Monopolstellung in der HBM-Packaging-Technologie die starke Preissetzung.

Der anhaltende Preisanstieg bei HBM schmälerte direkt die Gewinnspanne der GPU-Hersteller und führte mitunter dazu, dass High-End-Grafikkarten wegen fehlender Speicherchips nicht ausgeliefert werden konnten.

Diese defensive Situation ist für Nvidia – das auf höchste Effizienz und Kostenkontrolle setzt – nicht akzeptabel.

„Aus Schaden wird man klug.“ Nvidia weiß: Vor dem Hintergrund exponentiell steigender Rechenleistungsdichte wird der nächste Flaschenhals nicht der Speicher, sondern die „Bandbreite“ und „Leistungsaufnahme“ der Datenübertragung sein.

Mit der Entwicklung von KI-Clustern von zehntausend auf hunderttausende Karten stößt die traditionelle elektrische Vernetzung an physikalische Grenzen.

Bei der Übertragung von Hochgeschwindigkeitssignalen steigen die Verluste und die Wärmeentwicklung von Kupferkabeln exponentiell, die Power Wall wird zum größten Hindernis für die Freisetzung von Rechenleistung.

Daten zeigen: In High-Speed-Szenarien kann der Energieverbrauch der I/O-Schnittstellen sogar den Chip selbst übersteigen. In diesem Moment ist die optische Vernetzung keine Option mehr, sondern Pflicht.

Die Co-Packaged Optics (CPO)-Technologie – durch die Integration von optischem Engine und Switch-Chip – verkürzt die elektrische Signalübertragungsdistanz drastisch und ist die einzig praktikable Antwort auf die Energieprobleme der nächsten Generation „Gigawatt-Fabriken für KI“.

Wer die Kapazität für High-End-Laser und Silizium-Photonik beherrscht, kontrolliert den Takt der Entwicklung von Rechenzentren.

Doch: Die CPO-Wertschöpfungskette ist weitaus unreifer als die traditionelle optische Module, der Kapazitätsausbau ist langsam und die technische Hürde hoch. Würde man abwarten, dass die Lieferkette organisch reift, könnte Nvidia das gleiche Schicksal wie HBM erleiden – bei starkem Nachfrageausbruch wären Kernkomponenten knapp oder Lieferanten hätten Preismacht.

Daher entschied sich Nvidia diesmal, nicht abzuwarten, sondern wurde direkt kapitalmäßiger Mitgestalter der Lieferkette.

Die Investition in Lumentum und Coherent und die Kapazitätsbindung ist im Kern eine „defensive Offensive“. Es ist keine einfache Finanzinvestition, die kurzfristige Kursgewinne anstrebt, sondern langfristige Sicherheit der Lieferkette und kontrollierbare Kosten.

Über das Kapital bündelt Nvidia die zuvor lose Geschäftspartnerschaft zu einer „Kapazitätsgemeinschaft mit Interessenbindung“ auf.

Dies ist ein offen ausgetragener Plan: Noch bevor optische Module zur knappen Ressource werden, werden hochwertige Kapazitäten ins eigene Portfolio integriert, um sicherzustellen, dass Nvidia beim CPO-Boom als erstes Priorität erhält.

Von 35% noch höher: LITE und die „Super-Aufträge“

Fast schon auf der Zeitleiste geschrieben

In der Verbindung von Kapital und Technologie ist Lumentum (LITE) zweifellos einer der größten Gewinner.

Die Finanzdaten verdeutlichen die Tiefe dieser Beziehung. Im Geschäftsjahr 2024 trug NVIDIA bereits rund 35% zum Umsatz von Lumentum bei.

Das heißt: LITE ist bereits ein eng gebundener, zentraler Lieferant für den GPU-Giganten. Die aktuelle Investition von 2 Milliarden US-Dollar, ergänzt durch Einkaufsverpflichtungen im Milliardenbereich, bedeutet den Sprung vom „wichtigen Kunden“ zum „strategischen Symbionten“.

Wir können eine konservative Prognose zu den künftigen Auftragsvolumen machen. Angenommen, das Gesamtvolumen der Einkaufsverpflichtungen und Neuaufträge übersteigt in den nächsten vier Jahren 5 Milliarden US-Dollar, ergibt das etwa 1,25 Milliarden US-Dollar zusätzlichen Umsatz pro Jahr.

Da Lumentum aktuell einen Jahresumsatz von etwa 2 Milliarden US-Dollar erzielt, könnte das theoretische Umsatzmaximum 4 Milliarden US-Dollar erreichen – fast eine Verdopplung.

Doch es ist nicht nur eine bloße Zahlenaddition, sondern eine strukturelle Steigerung der Profitabilität.

Erstens: Die Stückpreise (ASP) und die Bruttogewinnstruktur von optischen Modulen für KI-Rechenzentren sind weit besser als die bei traditionellen Telekom-Produkten. Letztere leiden unter dem Capex-Zyklus der Netzbetreiber, der Preiswettbewerb ist intensiv und die Margen dünn.

KI-Optomodule sind Teil der Hochleistungskomponenten – Stabilität und Geschwindigkeit sind entscheidend, der Kunde ist weniger preissensibel, sondern verlangt Lieferfähigkeit.

Damit werden Nvidias Aufträge den Gesamt-Bruttogewinn von LITE deutlich nach oben bringen.

Zweitens: CPO ist technologisch im High-End-Bereich, die Wettbewerber sind begrenzt, Angebot eher wenig elastisch. Silizium-Photonik umfasst komplexes Chipdesign und Packaging-Prozesse. Weltweit gibt es nur wenige, die große Mengen produzieren können. Wegen begrenztem Angebot hat LITE als Hauptlieferant stärkere Verhandlungsmacht.

Drittens: Nvidias neue Rubin-Architektur-Generation ist zeitlich eng mit der CPO-Einführung verzahnt. Der Markt erwartet, dass Rubin die Nachfrage nach Optovernetzung stark steigert, um die großen Anforderungen an Speicherbandbreite und interne Cluster-Kommunikation zu erfüllen. Die Bestell-Sicherheit ist groß – fast schon auf der Zeitleiste fixiert.

War LITE bislang eine gewöhnliche Optomodul-Firma, deren Performance dem Zyklus der Branche folgte, ist das Unternehmen jetzt ein strategischer Knotenpunkt, den Nvidia exklusiv „vorgebucht“ hat. Die Performance wird nicht mehr bloß vom Telekom-Markt abhängen, sondern direkt mit dem Fortschritt beim Aufbau der globalen KI-Rechenleistungen verknüpft.

Die Reaktion des Kapitalmarkts ist oft ehrlicher als Worte. Die jüngste Kursentwicklung bei LITE reflektiert nicht bloß die Nachrichtenlage, sondern die Sichtbarkeit der Bestellungen.

Investoren durchdringen die Logik: Im KI-Rüstungswettlauf mag es Wettbewerb unter Schaufelverkäufern geben – doch der Lieferant, den der „Waffenhändler“ mit seinem Kapital investiert und Kapazität bindet, ist unersetzbar.

Der eigentliche Konflikt: Wird Optovernetzung

zum nächsten HBM?

Mit Nvidias Einstieg entstehen Kontroversen – die Erwartungen an Optomodule gehen auseinander.

Einige konservative Investoren befürchten: CPO-Technologie befindet sich noch im Einführungsstadium, das Ökosystem ist nicht ausgereift, die Skalierung dauert wahrscheinlich noch Jahre, kurzfristig gibt es keine großen Profite.

Andere glauben: Sobald der Bau der „Gigawatt KI-Fabriken“ beginnt, wird die Nachfrage nach Optomodulen weit über Branchenfantasie hinausgehen und das Explosionspotenzial könnte dem von HBM gleichkommen oder es sogar übertreffen.

Der wahre Konflikt: Wird Optovernetzung das neue HBM? Wird es zum Schlüssel-Flaschenhals für die Entwicklung der Rechenleistung und damit zu drastischen Preis- und Gewinnverschiebungen führen?

Zwei Schlüsselvariablen sind entscheidend.

Erstens: Exponentielle Ausdehnung der KI-Cluster. Aktuell werden KI-Trainingscluster von zehntausenden auf hunderttausende Karten ausgedehnt. In diesem Maßstab explodieren die Anforderungen an Bandbreite zwischen Karten und Servern exponentiell.

Elektrische Vernetzung stößt bei Energieverbrauch und Signalqualität an physikalische Grenzen, sie reicht für längere Strecken und höhere Geschwindigkeit nicht aus. Überschreitet CPO den kritischen Punkt, kann es blitzschnell den HBM-Weg nachbilden: Von der „Optional-Konfiguration“ zur „Standard-Konfiguration“, die Nachfrage bricht aus.

Zweitens: Die Investitionen von Nvidia verändern Angebot und Nachfrage. Vorab Kapazität zu sichern bedeutet, dass die Versorgung mit hochwertigen Laser-Komponenten in den kommenden Jahren „strategisch blockiert“ sein wird. Dies setzt andere GPU-Hersteller unter Druck.

AMD, Intel und andere Custom-Chipfirmen könnten beim Wettlauf um High-End-Optomodul-Kapazität scheitern – man hat Geld, kann aber nicht kaufen, oder muss einen höheren Preis zahlen. Diese Angebotslücke wird die gesamte Branche weiter anheizen.

In der Anlegerperspektive ist das ein deutlicher Kompass für den Markt.

Wenn Rechenleistungs-Giganten mit Kapital ins upstream greifen, hat die Gewinnzone der Wertschöpfungskette ihre Position verändert.

Im frühen GPU-Zeitalter lag der größte Gewinn beim Chipdesign; als HBM zum Flaschenhals wurde, verschob sich das Geld zum Speicher; nun ist die optische Vernetzung das neue profitable Terrain.

Nvidia wettet nicht auf eine einzelne Firma – sondern baut für die nächste Generation Rechenleistungsarchitektur eine „Lichtgeschwindigkeitsstraße“ und sorgt dafür, dass der Burggraben des eigenen Ökosystems nicht nur tief, sondern auch breit ist.

Für Lumentum ist das praktisch ein bereits geschriebenes Wachstumsskript. Doch die Kapitalmärkte fragen nicht nur: „Wird es wachsen?“, sondern vor allem – wenn Optomodule wirklich explodieren, reicht die Bewertung dann überhaupt der Geschwindigkeit nach?

Die aktuelle Marktpreisbildung spiegelt vielleicht nur kurzfristige Einkaufsverpflichtungen wider, berücksichtigt aber wohl noch nicht den Monopolaufschlag nach vollständiger CPO-Durchdringung.

Betritt die Branche den „Verkäufermarkt“ mit Angebotsmangel, ändern sich die Bewertungslogik: Firmen mit Kapazitätsbindung werden vom „Produktionsbetrieb“ zum „Ressourcenbetrieb“.

Schlusswort:Das zweite Halbzeit der Rechenleistungs-Kriege

Nvidias Kapazitätsbindung bei Lumentum und Coherent ist das zentrale Signal dafür, dass der KI-Rechenleistungswettlauf in die „zweite Halbzeit“ startet.

Die erste Halbzeit ist der Wettstreit um Chip-Rechenleistung – Transistorenzahl und Architektur-Effizienz; die zweite Halbzeit ist der Wettstreit um Systemeffizienz: Datentransferrate und Energiekontrolle.

In dieser Phase sind Optomodule keine Randkomponenten mehr, sondern der zentrale Knoten für Cluster-Effizienz.

Jensen Huangs „frühe Kapazitätsbindung“ ist eine Reaktion auf das HBM-Flaschenhalsproblem und zugleich eine strategische Wette auf den künftigen Technologieweg.

Die Botschaft an die gesamte Wertschöpfungskette ist klar: Im KI-Zeitalter sind Sicherheit und Kontrolle der Lieferkette genauso wertvoll wie technologische Innovation selbst.

Für Investoren bedeutet das: Der Fokus sollte nicht nur auf GPU-Herstellern liegen, sondern auch auf upstream-Unternehmen mit Kerntechnologie für die optische Vernetzung und tiefer Bindung an Giganten.

Denn wenn die Flut abebbt und die Lichter der Rechenleistungsfabriken angehen, erhellen das System jene „Lichter“, die bereits vorab gesichert wurden.

Die Optomodul-Rüstungswettlauf hat begonnen, und der Startschuss fiel mit Nvidias Kapitaleinstieg. In diesem Wettlauf gilt: Wer das Licht beherrscht, kontrolliert die Geschwindigkeit der KI-Zukunft.

Haftungsausschluss: Der Inhalt dieses Artikels gibt ausschließlich die Meinung des Autors wieder und repräsentiert nicht die Plattform in irgendeiner Form. Dieser Artikel ist nicht dazu gedacht, als Referenz für Investitionsentscheidungen zu dienen.

Das könnte Ihnen auch gefallen

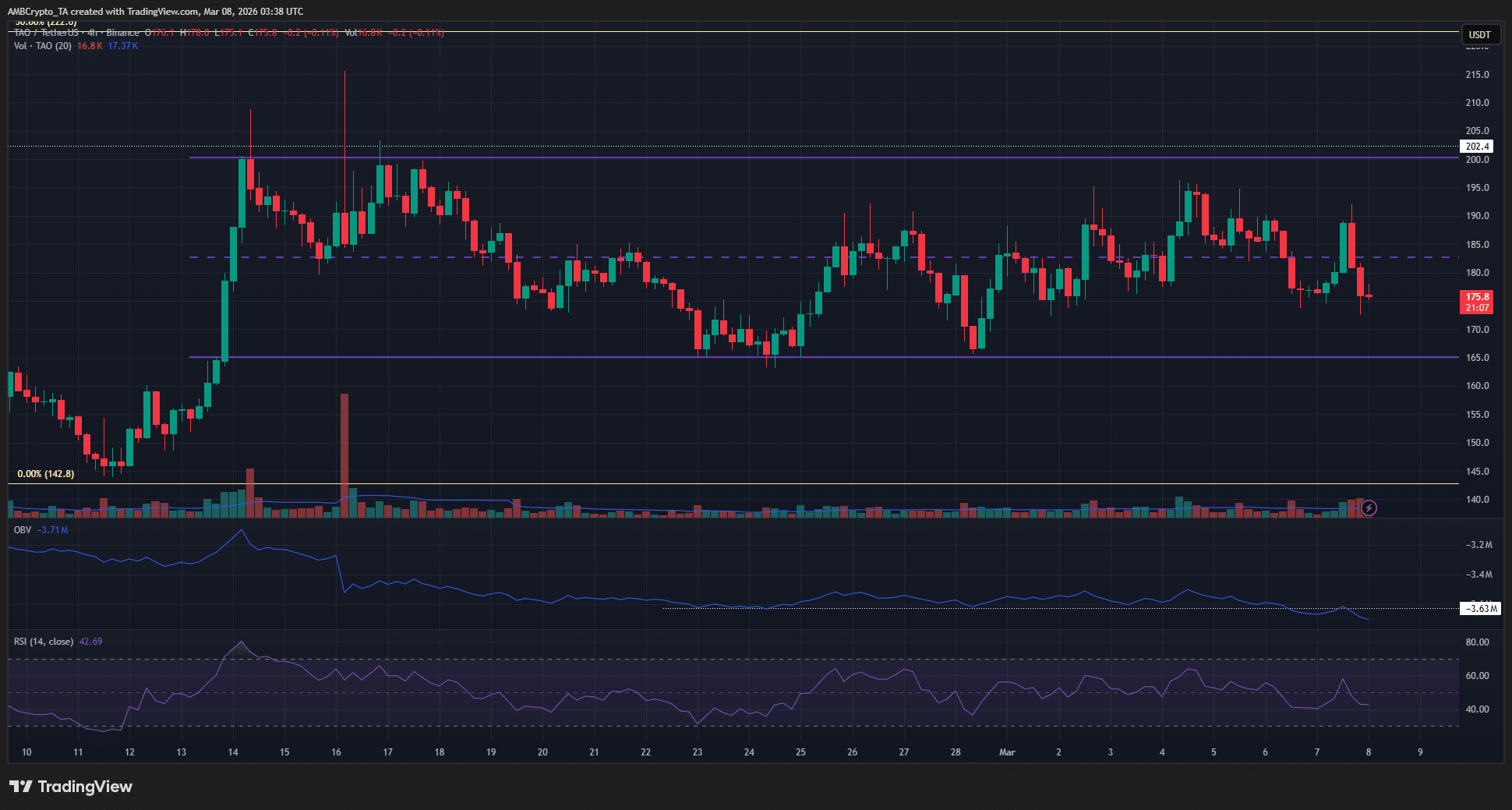

Bitcoin-"Bullenfalle" bildet sich, während der Bärenmarkt in die mittlere Phase eintritt: Willy Woo

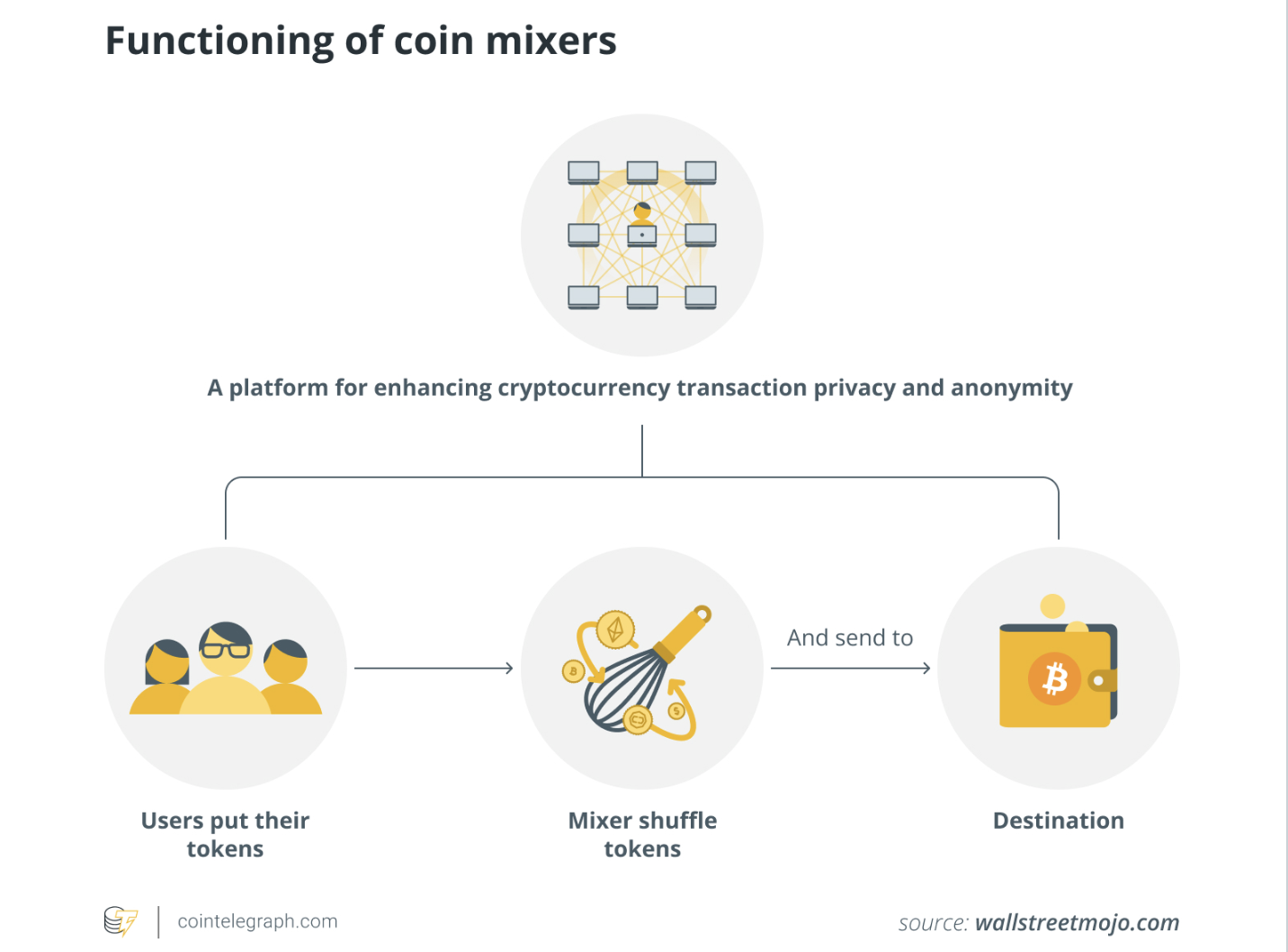

Bericht des US-Finanzministeriums erkennt legitime Verwendungszwecke von Krypto-Mixern an

Großbritannien hat nur noch zwei Tage Gasvorrat, da die Importe aus dem Nahen Osten zum Erliegen kommen