Meta stellt vier weitere KI-Prozessoren vor und verschärft damit den Wettbewerb mit Nvidia und AMD

Meta präsentiert neue KI-Prozessoren

Meta (META) hat im Rahmen seiner Meta Training and Inference Accelerator (MTIA)-Produktreihe vier fortschrittliche KI-Chips vorgestellt. Dieser Schritt ist Teil der Strategie von Meta, sowohl kommerzielle GPUs von Nvidia und AMD als auch eigene Hardware zu nutzen, um die Anforderungen im Bereich KI zu erfüllen und die Abhängigkeit von einzelnen Zulieferern zu verringern.

Überblick über MTIA-Chips

- MTIA 300

- MTIA 400

- MTIA 450

- MTIA 500

Jeder Chip ist speziell darauf ausgelegt, bestimmte Aspekte der KI-Operationen von Meta abzudecken, von Ranking- und Empfehlungssystemen bis hin zu komplexen Inferenz-Aufgaben.

MTIA 400: Generative KI und Skalierbarkeit

Der MTIA 400 ist für generative KI sowie Ranking- und Empfehlungs-Workloads entwickelt worden. Meta weist darauf hin, dass bis zu 72 dieser Chips in einem einzigen Server-Rack integriert werden können, was dem Ansatz ähnelt, den Nvidia bei NVL72 und AMD bei den Helios-Racks verwendet.

Meta betont, dass der MTIA 400 der erste Prozessor ist, der sowohl Kosteneffizienz als auch eine Leistung vergleichbar mit erstklassigen kommerziellen Produkten bietet. Die spezifischen Produkte werden jedoch nicht genannt. Nvidia und AMD sind hierbei die Hauptkonkurrenten.

Aktuelle Partnerschaften

Meta hat kürzlich langfristige Vereinbarungen mit Nvidia und AMD über die Lieferung von Chips getroffen, um den Zugang zu mehreren Generationen ihrer Technologie zu sichern.

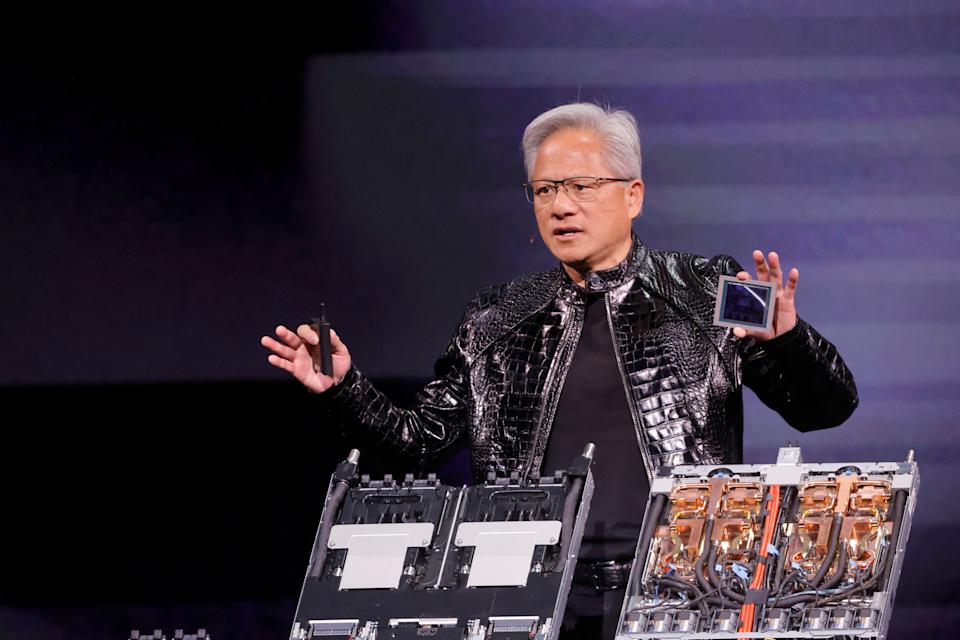

Nvidia CEO Jensen Huang präsentiert einen Rubin GPU während einer Keynote auf der CES 2026 in Las Vegas. (REUTERS/Steve Marcus)

Fortschritte mit MTIA 450 und MTIA 500

Der MTIA 450 verfügt im Vergleich zum Vorgängermodell über verbesserten High-Bandwidth-Speicher, während der MTIA 500 die Kapazität und Geschwindigkeit des Speichers weiter erhöht.

Pläne zur Einführung

Meta verwendet bereits einige dieser Chips und plant, die übrigen Modelle in den Jahren 2026 und 2027 einzuführen. Alle Prozessoren basieren auf einer einheitlichen Infrastruktur, sodass Upgrades problemlos möglich sind.

Branchentrends

Meta ist nicht die einzige Firma, die eigene KI-Chips entwickelt. Google und Amazon nutzen schon lange eigene Prozessoren für KI-Training und Inferenz, während Microsoft kürzlich den Maia 200 Chip auf den Markt gebracht hat.

Google und Amazon stellen ihre Chips zudem Anthropic für das Ausführen von KI-Modellen zur Verfügung. Laut The Information haben Google und Meta eine Milliardendeal abgeschlossen, damit Meta die Prozessoren von Google verwendet.

Auswirkungen auf Nvidia und AMD

Der Trend hin zu individuellen Chips stellt eine Herausforderung für Nvidia und AMD dar. Die Finanzchefin von Nvidia, Colette Kress, erklärte kürzlich, dass mehr als die Hälfte des Unternehmensumsatzes im Bereich Rechenzentren von sogenannten Hyperscale-Kunden stammt.

Trotzdem verzeichnet Nvidia weiterhin Umsatzwachstum durch andere Kundengruppen.

Hyperscale-Unternehmen investieren weiterhin in KI

Die großen Cloud-Anbieter zeigen keine Anzeichen dafür, ihre Investitionen in KI-Infrastruktur oder Drittanbieter-Chips zu verringern. Allein im Jahr 2026 werden Amazon, Google, Meta und Microsoft voraussichtlich gemeinsam 650 Milliarden Dollar in Investitionen tätigen, wobei ein bedeutender Teil in die Entwicklung von KI fließt.

Abonnieren Sie den Week in Tech-Newsletter von Yahoo Finance, um auf dem neuesten Stand zu bleiben.

Haftungsausschluss: Der Inhalt dieses Artikels gibt ausschließlich die Meinung des Autors wieder und repräsentiert nicht die Plattform in irgendeiner Form. Dieser Artikel ist nicht dazu gedacht, als Referenz für Investitionsentscheidungen zu dienen.

Das könnte Ihnen auch gefallen

Gold erholt sich, da sichere Häfen die inflationsbedingten Fed-Zinssorgen ausgleichen

MAPS verzeichnet Verluste, da der Umsatz einbricht und der Ausblick schwächer wird

Afya (AFYA) überstannt likes Q4-Gewinnerwartungen

Warum Bitcoin in dieser NBoche trotz Unruhen im Nahen Osten seinen Höchststand erreicht hat