Esclusivo - OpenAI non è soddisfatta di alcuni chip Nvidia e sta cercando alternative, secondo fonti

Di Max A. Cherney, Krystal Hu e Deepa Seetharaman

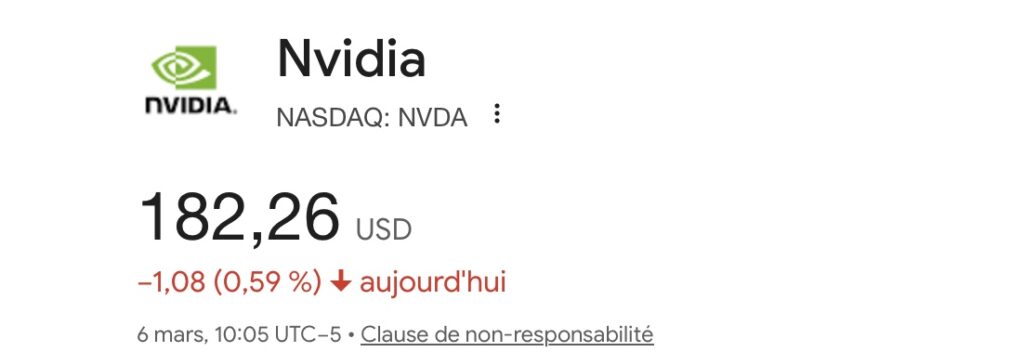

SAN FRANCISCO, 2 febbraio (Reuters) - OpenAI non è soddisfatta di alcuni degli ultimi chip di intelligenza artificiale di Nvidia e ha cercato alternative dallo scorso anno, hanno detto otto fonti a conoscenza della questione, potenzialmente complicando il rapporto tra i due attori più in vista nel boom dell'IA.

Il cambio di strategia da parte del creatore di ChatGPT, i cui dettagli vengono riportati per la prima volta qui, riguarda un'enfasi crescente sui chip utilizzati per eseguire specifici elementi dell'inferenza IA, il processo in cui un modello di IA come quello che alimenta l'app ChatGPT risponde alle domande e richieste dei clienti. Nvidia rimane dominante nei chip per l'addestramento di grandi modelli IA, mentre l'inferenza è diventata un nuovo fronte della competizione.

Questa decisione di OpenAI e di altri di cercare alternative nel mercato dei chip per l'inferenza rappresenta una prova significativa del dominio di Nvidia nell'IA e arriva mentre le due aziende sono in trattative di investimento.

A settembre, Nvidia ha dichiarato di voler investire fino a 100 miliardi di dollari in OpenAI come parte di un accordo che ha dato al produttore di chip una quota nella startup e ha fornito a OpenAI i fondi necessari per acquistare i chip avanzati.

Secondo quanto riportato da Reuters, l'accordo avrebbe dovuto concludersi entro poche settimane. Invece, le trattative si sono protratte per mesi. Nel frattempo, OpenAI ha stipulato accordi con AMD e altri per GPU progettate per competere con quelle di Nvidia. Tuttavia, il cambiamento della roadmap dei prodotti ha anche modificato il tipo di risorse computazionali richieste e ha rallentato le trattative con Nvidia, secondo una persona a conoscenza della questione.

Sabato, il CEO di Nvidia Jensen Huang ha liquidato come “sciocchezze” le voci di tensioni con OpenAI, affermando che Nvidia prevede un enorme investimento in OpenAI.

"I clienti continuano a scegliere NVIDIA per l'inferenza perché offriamo le migliori prestazioni e il miglior costo totale di proprietà su larga scala", ha dichiarato Nvidia in una nota.

Un portavoce di OpenAI, in una dichiarazione separata, ha affermato che l'azienda si affida a Nvidia per alimentare la grande maggioranza della propria flotta di inferenza e che Nvidia offre le migliori prestazioni per dollaro per l'inferenza.

Sette fonti hanno riferito che OpenAI non è soddisfatta della velocità con cui l'hardware Nvidia può fornire risposte agli utenti di ChatGPT per specifici tipi di problemi come lo sviluppo software e la comunicazione tra IA e altri software. Ha bisogno di nuovo hardware che in futuro dovrebbe fornire circa il 10% delle necessità computazionali di inferenza di OpenAI, ha detto una delle fonti a Reuters.

Il creatore di ChatGPT ha discusso con startup tra cui Cerebras e Groq per fornire chip per un'inferenza più veloce, hanno detto due fonti. Ma Nvidia ha concluso un accordo di licenza da 20 miliardi di dollari con Groq che ha interrotto i colloqui con OpenAI, ha detto una delle fonti a Reuters.

Esclusione di responsabilità: il contenuto di questo articolo riflette esclusivamente l’opinione dell’autore e non rappresenta in alcun modo la piattaforma. Questo articolo non deve essere utilizzato come riferimento per prendere decisioni di investimento.

Ti potrebbe interessare anche

Le nuove restrizioni statunitensi sull'IA causano un crollo delle azioni Nvidia

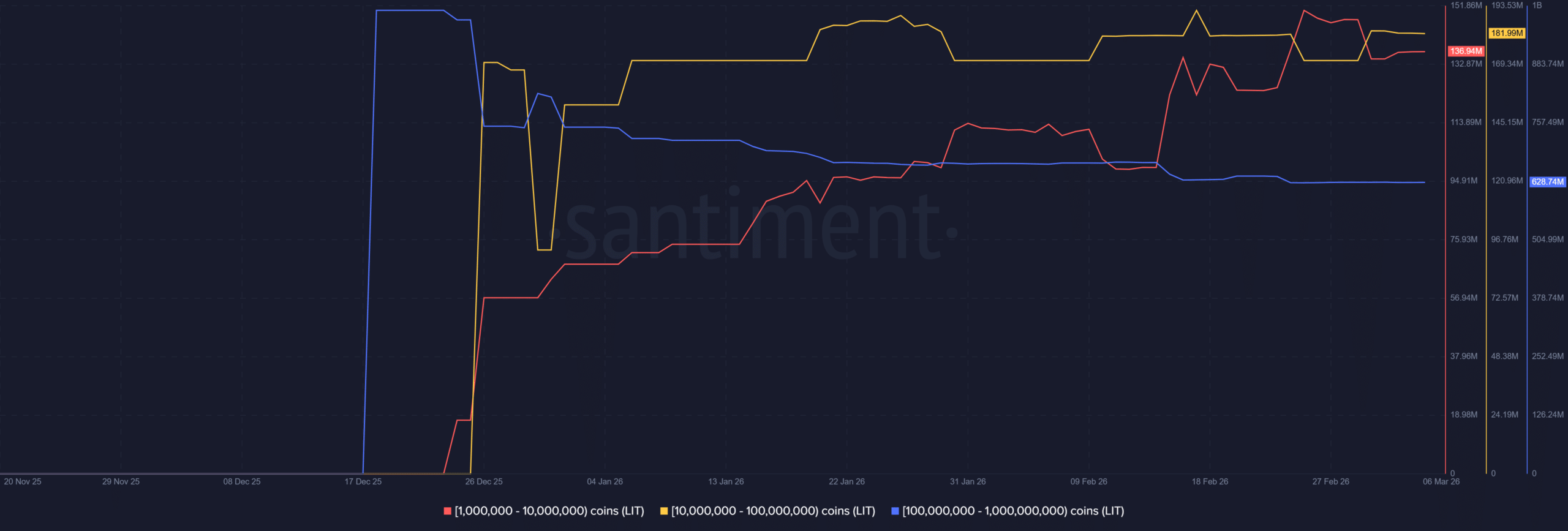

Shock di liquidità? LIT crolla del 16% dopo che Justin Sun ritira fondi da Lighter