Ultimo rapporto sui semiconduttori di Morgan Stanley: il ciclo di potenza di calcolo dell'AI si sta espandendo verso lo storage e il packaging

Il 5 marzo 2026, Morgan Stanley ha pubblicato un rapporto di ricerca sull’industria asiatica dei semiconduttori:

《Greater China Semiconductors – Bullish on Cloud, Memory and Optical Outlook; Accumulating Ahead of GTC》.

Secondo il rapporto, la forza trainante centrale dell’industria dei semiconduttori rimane la costruzione di infrastrutture di intelligenza artificiale, ma il focus del mercato sta cambiando.

Se il ciclo dell’AI del 2023–2024 era concentrato principalmente sulle GPU, dal 2025–2026 la domanda AI inizia a diffondersi lungo una filiera dei semiconduttori più ampia, includendo:

Memoria (Memory)

Packaging avanzato (Advanced Packaging)

ASIC personalizzati

Reti dei data center

La conclusione di Morgan Stanley è:

Gli investimenti in potenza di calcolo AI sono ancora nella fase di espansione, e il settore dei semiconduttori sta entrando in un nuovo ciclo di domanda strutturale.

I. Il CAPEX delle cloud company continua ad espandersi

La domanda principale di semiconduttori per AI proviene ancora dai fornitori cloud.

Secondo le statistiche di Morgan Stanley:

Nel quarto trimestre del 2025, gli investimenti in conto capitale delle quattro principali cloud mondiali (Amazon, Microsoft, Google, Meta) sono cresciuti anno su anno di 64%.

Se si estende l’analisi alle prime dieci cloud al mondo, Morgan Stanley prevede:

Nel 2026 il CAPEX globale sul cloud computing si avvicinerà a 685 miliardi di dollari.

Nelle previsioni di più lungo termine, il CEO di NVIDIA Jensen Huang aveva affermato:

Gli investimenti globali nelle infrastrutture AI potranno arrivare a 1.000 miliardi di dollari prima del 2028.

Questa tendenza significa che:

Lo sviluppo delle infrastrutture AI è ancora in una fase espansiva, contrariamente alle preoccupazioni del mercato su un picco massimo imminente.

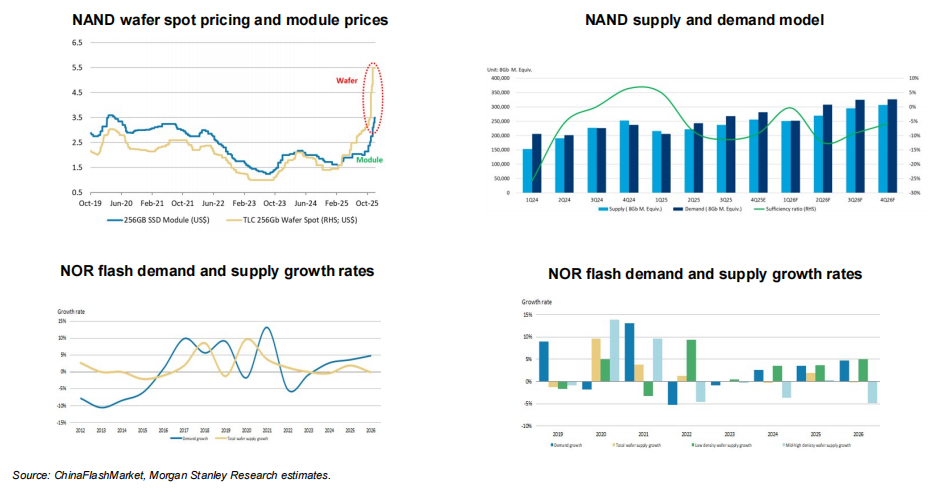

II. L’inferenza AI sta cambiando la struttura della domanda di memoria

Morgan Stanley ritiene che l’anello più sottovalutato in questo ciclo AI sia ladomanda di memoria.

I modelli di inferenza AI necessitano di conservare enormi quantità di dati di contesto (Context Memory),

da cui nasce la richiesta per nuove architetture di storage.

Il rapporto introduce un concetto:

ICMS (Inference Context Memory Storage)

cioè sistemi di storage dedicati al contesto per l’inferenza AI.

Secondo le stime di Morgan Stanley:

Entro il 2027, la richiesta per l’inferenza AI assorbirà un ulteriore 13% della domanda globale di NAND.

Contestualmente, anche il mercato NOR Flash potrebbe entrare in uno stato di offerta ristretta.

Il rapporto conclude che:

La domanda AI di storage potrebbe innestare un nuovo ciclo rialzista del settore della memoria.

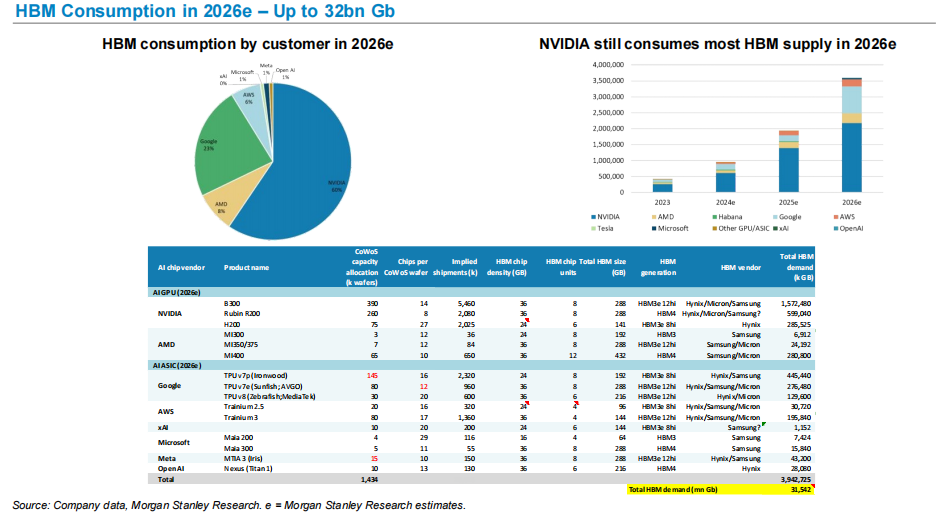

III. L’HBM diventa il collo di bottiglia chiave della potenza AI

Uno dei principali fattori nel miglioramento delle prestazioni dei chip AI è la memoria ad alta banda (HBM).

Morgan Stanley prevede:

Nel 2026 la domanda globale di HBM potrà raggiungere circa 32 miliardi di Gb.

Nella composizione della domanda:

NVIDIA resta il maggior consumatore di HBM.

La richiesta di HBM da parte delle GPU AI e degli ASIC AI sta crescendo rapidamente, rendendo l’HBM la risorsa chiave nella catena di approvvigionamento dell’elaborazione AI.

Questo spiega anche perché:

SK Hynix

Micron

Samsung

si stanno distinguendo nel ciclo AI.

IV. Il packaging avanzato è il nuovo collo di bottiglia per la capacità produttiva delle AI chip

Le AI GPU richiedono non solo tecnologie di processo avanzate ma anche un packaging avanzato altamente specializzato.

Morgan Stanley prevede:

La capacità di packaging avanzato CoWoS di TSMC potrebbe raggiungere 125k wafer mensili entro il 2026.

La domanda è principalmente trainata da:

NVIDIA

AMD

Chip AI proprietari delle big cloud

Il packaging avanzato sta dunque diventando il nuovo collo di bottiglia nella filiera dei chip AI.

V. Gli AI ASIC stanno emergendo rapidamente

Oltre alle GPU, i fornitori cloud stanno sviluppando in massa chip AI proprietari.

I principali progetti attuali includono:

Google TPU

Amazon Trainium

Microsoft Maia

Meta MTIA

Morgan Stanley prevede una crescita costante delle spedizioni di AI ASIC nei prossimi anni.

Ad esempio:

Il volume delle spedizioni della serie AWS Trainium continuerà a crescere nei prossimi anni.

Ciò significa che il mercato dell’elaborazione AI vedrà uno scenario di:

sviluppo parallelo GPU + ASIC.

VI. L’alternativa cinese alle GPU AI sta avanzando

Il rapporto fornisce anche previsioni sull’industria cinese dei chip AI.

Morgan Stanley prevede:

Il tasso di autosufficienza delle GPU cinesi crescerà dal 34% del 2024 al 50% nel 2027.

Allo stesso tempo, il mercato cloud AI cinese dovrebbe raggiungere nel 2027:

circa 48 miliardi di dollari.

Questo segnala una certa regionalizzazione della catena industriale globale dell’elaborazione AI.

Il mio punto di vista

Se dovessimo riassumere il tutto in una frase, è semplice:

Il ciclo AI dei semiconduttori si sta diffondendo dalla “capacità di calcolo” a “tutta la supply chain”.

In una prima fase il mercato guardava solo alle GPU.

Ma con l’espansione delle infrastrutture AI, la domanda si sta allargando verso:

Memoria

Packaging avanzato

Chip di rete

ASIC personalizzati

Questo significa che:

L’AI non è più un ciclo di un solo chip, ma un ciclo di domanda strutturale per tutta la catena industriale dei semiconduttori.

Per l’industria dei semiconduttori,

il vero cambiamento non è la sola domanda di GPU, mala costruzione a lungo termine delle infrastrutture di potenza computazionale.

Esclusione di responsabilità: il contenuto di questo articolo riflette esclusivamente l’opinione dell’autore e non rappresenta in alcun modo la piattaforma. Questo articolo non deve essere utilizzato come riferimento per prendere decisioni di investimento.

Ti potrebbe interessare anche

Victoria's Secret: Panoramica dei risultati finanziari del quarto trimestre

Come l’acquisizione nascosta di Road da parte di Ripple potenzierà l’utilità di XRP

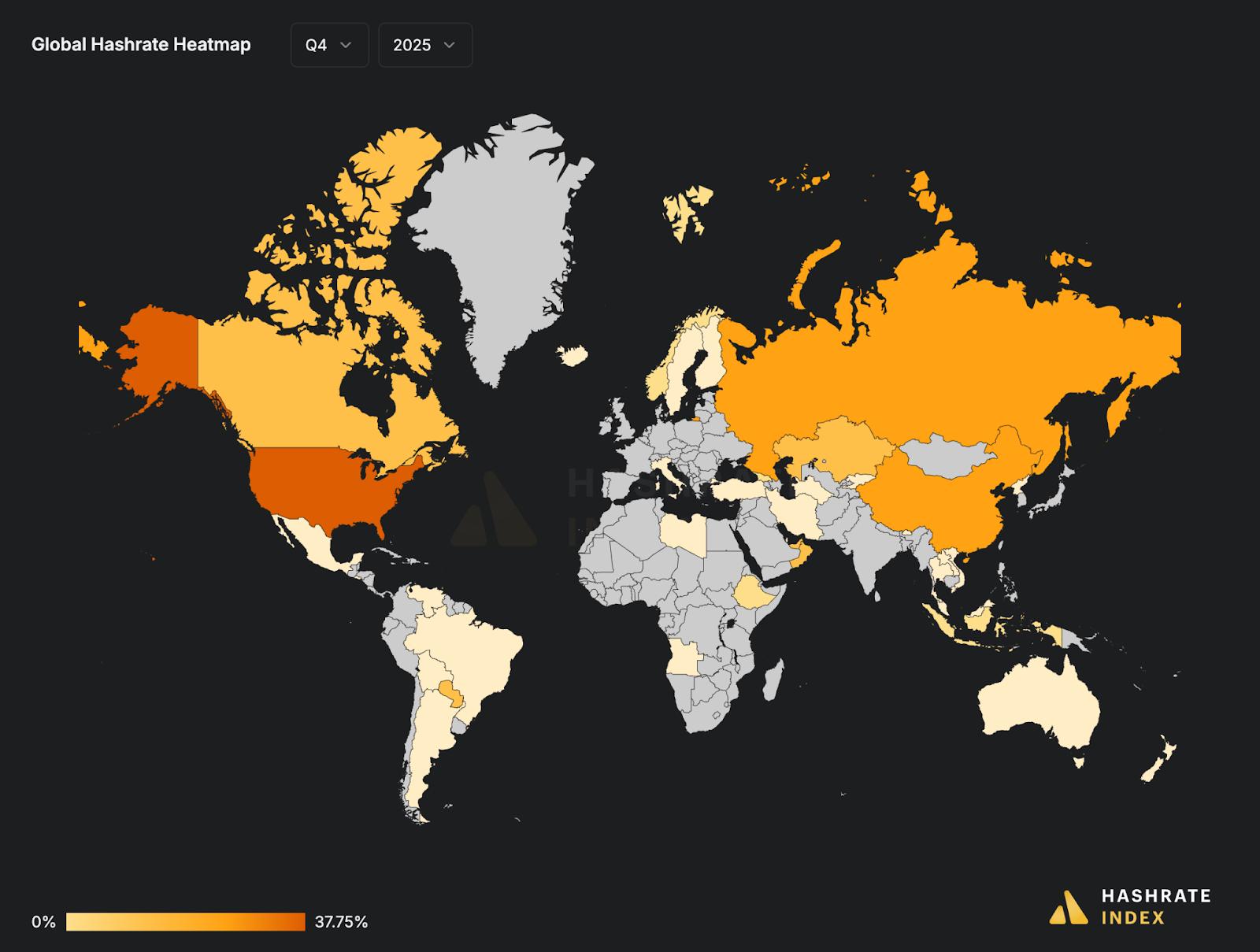

Bitcoin è ora un protagonista principale nella guerra globale dell'energia

Offerta mattutina: I mercati globali tirano un respiro