Huang ha bloccato le sue posizioni in anticipo: alla vigilia dell’esplosione di CPO, i moduli ottici entrano in una “corsa agli armamenti”

Fonte: Ricerca sul mercato azionario statunitense

Nell’impetuosa avanzata dell’intelligenza artificiale, l’attenzione del mercato si concentra spesso sull’iterazione della potenza di calcolo delle GPU, trascurando però il “sistema nervoso” che supporta questa vasta rete di potenza computazionale.

Mentre tutti ancora discutono su come suddividere la capacità produttiva di H100 e B200, Jensen Huang, fondatore di NVIDIA, ha già rivolto lo sguardo a infrastrutture di livello più profondo: l’interconnessione ottica.

Di recente, il mercato ha divulgato che NVIDIA ha investito 2 miliardi di dollari ciascuna nei giganti dell’ottica di comunicazione Lumentum e Coherent, firmando impegni di acquisto miliardari e garantendosi diritti sulle future capacità produttive.

Questo movimento, che a prima vista sembra un investimento finanziario, in realtà rappresenta un “blocco strategico” delle infrastrutture di potenza di calcolo.

Ciò segna una svolta fondamentale nella logica competitiva della filiera AI: dalla semplice corsa alla prestazione dei chip, all’integrazione e al vincolo di capitale con la supply chain core a monte e alla fissazione della capacità produttiva.

I moduli ottici, in particolare la tecnologia Co-Packaged Optics (CPO), stanno per essere protagonisti di un boom imminente, accendendo silenziosamente una “corsa agli armamenti” dell’interconnessione ottica.

Non è un investimento, è una lock-up: NVIDIA

Si prepara ad una possibile carenza dei moduli ottici

Per cogliere il significato profondo di questa mossa NVIDIA, bisogna ricordare la lezione degli ultimi due anni con la curva dei profitti dei server AI, dove la memoria HBM (High Bandwidth Memory) ha rappresentato un “collo di bottiglia” imprevisto.

All’inizio dell’esplosione della potenza di calcolo AI, il mercato credeva che il vero limite fosse la capacità produttiva delle GPU. Tuttavia, con la domanda in crescita, il vero fattore limitante è diventato rapidamente HBM.

I tre giganti della memoria (SK Hynix, Samsung, Micron), grazie al loro monopolio sulla tecnologia di package HBM, hanno acquisito grande potere di determinazione dei prezzi.

L’aumento continuo del prezzo di HBM ha eroso direttamente i margini di profitto dei produttori di GPU e ha persino causato impossibilità di consegna di alcune schede di fascia alta per mancanza di memoria.

Questa situazione passiva è inaccettabile per NVIDIA, focalizzata sull’efficienza estrema e sul controllo dei costi.

“Fare tesoro degli errori passati”. NVIDIA comprende bene che, nel contesto di una crescita esponenziale della densità di potenza di calcolo, il prossimo collo di bottiglia non sarà la memoria, ma la “larghezza di banda” e i “consumi” della trasmissione dati.

Con l’evoluzione dei cluster AI da decine a centinaia di migliaia di schede, la tradizionale tecnologia di interconnessione elettrica ha raggiunto i suoi limiti fisici.

Nella trasmissione di segnali ad altissima velocità, la dissipazione e il calore dei cavi in rame aumentano in modo esponenziale: il Power Wall è diventato il principale ostacolo per la liberazione della potenza di calcolo.

I dati mostrano che, in scenari ad alta velocità, il consumo energetico delle interfacce I/O può persino superare quello del chip stesso. In questo momento, l’interconnessione ottica non è più un’opzione, ma una necessità.

E la tecnologia CPO, integrando il motore ottico nel pacchetto del chip di switching, riduce drasticamente la distanza di trasmissione del segnale elettrico, diventando la soluzione imprescindibile al consumo energetico per le future “fabbriche di AI di livello gigawatt”.

Chi controlla la produzione di laser di fascia alta e fotonica del silicio, controlla il metronomo dell’evoluzione dei data center.

Ciononostante, la maturità della filiera CPO è molto più bassa rispetto ai moduli ottici tradizionali: la crescita della capacità produttiva è lenta e le barriere tecnologiche sono alte. Se si attendesse la naturale maturazione della supply chain, NVIDIA rischierebbe di ripetere la storia di HBM, trovandosi, durante un boom della domanda, con componenti fondamentali esauriti o rincarati alle stelle dai fornitori.

Per questo NVIDIA ha deciso di non aspettare, diventando invece co-costruttore di capitale nella supply chain.

L’investimento in Lumentum e Coherent con il blocco delle capacità produttive è fondamentalmente una “offensiva difensiva”. Non è un semplice investimento finanziario in cerca di ritorni di breve periodo, ma la ricerca di sicurezza della supply chain e controllo dei costi nel lungo periodo.

Attraverso legami di capitale, NVIDIA ha trasformato da relazioni commerciali sciolte in una “comunità di capacità produttiva” a interessi legati.

È una strategia quasi a carte scoperte: prima che i moduli ottici diventino risorse scarse, integrare le migliori capacità produttive nel proprio perimetro, garantendo che, nel boom CPO, i cluster di calcolo NVIDIA abbiano priorità d’accesso.

Dal 35% in su: la “super commessa” di LITE

Praticamente già scritta nella timeline

In quest’unione tra capitale e tecnologia, Lumentum (LITE) è senza dubbio uno dei maggiori beneficiari.

I dati finanziari rivelano la profondità della relazione tra le parti. Nell’esercizio 2024, NVIDIA ha già rappresentato circa il 35% delle entrate di Lumentum.

Questo significa che LITE è già oggi il fornitore core profondamente integrato col gigante GPU. Il recente ingresso di 2 miliardi di dollari in equity e impegni d’acquisto per decine di miliardi segna la trasformazione da “cliente importante” a “partner strategico simbiotico”.

Possiamo ipotizzare una stima prudente dell’entità delle commesse future: ammettiamo che nei prossimi quattro anni l’impegno e gli ordini aggiuntivi raggiungano i 5 miliardi di dollari, traducendosi in circa 1,25 miliardi di nuove entrate annuali.

Considerando che, attualmente, il fatturato annuo di Lumentum è intorno ai 2 miliardi di dollari, il suo tetto teorico potrebbe arrivare a circa 4 miliardi, quasi un raddoppio.

Ma non si tratta solo di una semplice somma numerica, quanto di una capitalizzazione strutturale della redditività.

In primis, il prezzo medio di vendita (ASP) e la struttura dei margini dei moduli ottici AI per i data center sono molto superiori a quelli dei prodotti per il mercato telecom tradizionale, dominato da una forte concorrenza di prezzo e bassi margini a causa dei limiti degli investimenti degli operatori.

I moduli ottici AI fanno parte delle infrastrutture di high performance computing, con esigenze stringenti in termini di stabilità e velocità; i clienti sono meno sensibili al prezzo, privilegiando la capacità di consegna.

In conseguenza, gli ordini NVIDIA daranno un forte impulso alla marginalità complessiva di LITE.

In secondo luogo, la tecnologia CPO è ancora nel campo delle barriere tecnologiche avanzate, con pochi concorrenti e un’offerta limitata. La fotonica del silicio coinvolge progettazione chip avanzata e processi di packaging molto complessi: a livello globale sono pochissime le aziende capaci di produrre in larga scala. In tale situazione, come fornitore core, LITE ha un potere di negoziazione molto forte.

In terzo luogo, il ciclo della nuova architettura Rubin di NVIDIA coincide con il deployment dei CPO. Il mercato si aspetta che Rubin aumenterà molto la domanda di interconnessione ottica, necessaria per supportare sia l’ampia banda di memoria che la comunicazione nei cluster. L’ordine è dunque quasi certo, praticamente inciso nella timeline.

Se in passato Lumentum era una comune società di moduli ottici soggetta ai cicli del settore, oggi somiglia più a un nodo strategico “prenotato” direttamente da NVIDIA con largo anticipo. La variabilità delle performance non sarà più legata solo al mercato telecom macroscopico, ma direttamente al ritmo di costruzione della potenza computazionale AI globale.

La reazione del mercato azionario è spesso la più sincera. Il recente forte andamento di LITE non è solo una lettura letterale degli annunci, ma la valorizzazione della visibilità degli ordini.

Gli investitori hanno compreso la logica: nella corsa agli armamenti per l’AI, fornire le pale può essere concorrenziale, ma il fornitore “scelto” e lock-up directly dagli “armieri” ha una posizione ineguagliabile.

Il reale conflitto: l’interconnessione ottica

diventerà il prossimo HBM?

Con l’ingresso di NVIDIA, sono sorte controversie. Le aspettative di mercato sui moduli ottici si sono divise.

Una parte di investitori prudenti teme che la tecnologia CPO sia ancora in fase di introduzione e la sua maturazione ecosistemica possa richiedere anni, rendendo difficile, nel breve periodo, trarne profitti rilevanti.

Un’altra corrente di pensiero sostiene che, una volta iniziata la creazione dei “super-fabbriche AI di livello GW”, la domanda di moduli ottici crescerà ben oltre l’immaginazione di mercato, in una crescita esplosiva che potrà replicare, se non superare, la traiettoria dell’HBM.

Il vero nodo del conflitto è: l’interconnessione ottica diventerà il prossimo HBM? Ovvero, sarà il nuovo collo di bottiglia centrale per lo sviluppo della potenza computazionale, generando forti riallocazioni di profitti e prezzi?

Le variabili chiave sono due.

Primo, l’espansione esponenziale della scala dei cluster AI: dai diecimila ai centomila schede. A questi livelli, la domanda di banda di comunicazione, sia tra singole schede che tra server, cresce in modo geometrico.

L’interconnessione elettrica è prossima al limite fisico in quanto a consumo e integrità del segnale e non può sostenere distanze maggiori e velocità più elevate. Una volta superata una certa soglia critica, la penetrazione dei CPO replicherà velocemente il percorso di HBM: da “opzione” a “standard”, con una domanda in rapido aumento.

Secondo, l’azione d’investimento di NVIDIA ha alterato la struttura della domanda e offerta. Bloccare capacità produttiva in anticipo significa che, nei prossimi anni, la fornitura di componenti laser di alta gamma sarà strategicamente riservata, esercitando pressione implicita sulla concorrenza GPU.

AMD, Intel e altri produttori di chip custom potrebbero trovarsi, competendo per moduli ottici di livello avanzato, nella situazione di non poterli acquistare neppure offrendo di più, o di dover pagare premi ancora più elevati. Questo mismatch tra domanda e offerta innalzerà ulteriormente lo stato di salute del settore dei moduli ottici.

Dal punto di vista degli investimenti, questo è un chiaro “segnale di direzione”.

Quando i grandi della potenza computazionale cominciano a estendere capitali a monte, il centro del profitto lungo la filiera si sta spostando.

All’inizio dello sviluppo delle GPU, il grosso dei margini si collocava sul design dei chip; con l’esplosione di HBM, la memoria è divenuta altamente redditizia; ora il nuovo campo di profitto è proprio l’interconnessione ottica.

NVIDIA non sta scommettendo su una singola azienda, ma sta costruendo un “canale alla velocità della luce” per la nuova architettura di potenza computazionale, garantendo che il suo ecosistema non abbia solo un fossato profondo, ma anche ampiezza.

Per Lumentum, questa è quasi una sceneggiatura di crescita già scritta con un lieto fine. Ma il vero quesito che pone il mercato non è “se crescerà”, bensì, quando esploderà la domanda dei moduli ottici, la valorizzazione sarà ancora in tempo per rifletterlo?

I prezzi correnti probabilmente riflettono solo le attese da impegni di acquisto di breve termine, mentre ancora non prezzano del tutto il premio monopolistico a lungo termine che seguirà una completa penetrazione dei CPO.

Una volta che il settore entrerà in una fase di mercato “di venditore”, le aziende capaci di assicurarsi capacità produttiva vedranno la propria logica valutativa transitare dalla “fabbricazione” alla “gestione di risorse”.

Conclusione:il “secondo tempo” della guerra della potenza computazionale

Il lock-up di NVIDIA in Lumentum e Coherent segna l’ingresso della guerra della potenza computazionale AI nel “secondo tempo”.

Il primo tempo vedeva la competizione sui chip, sfida di numero di transistor ed efficienza architetturale; il secondo tempo è la competizione sull’efficienza di sistema, puntando sulla velocità di trasmissione dati e il controllo dei consumi.

In questa fase, i moduli ottici non sono più componenti marginali, ma il perno chiave che determina l’efficienza del cluster di potenza di calcolo.

Questa “lock-up anticipata” di Jensen Huang è sia una reazione al collo di bottiglia di HBM sia una ferma scommessa sulla roadmap tecnologica futura.

Lancia un messaggio chiaro all’intera filiera: nell’era dell’AI, sicurezza e controllo della supply chain valgono quanto l’innovazione tecnologica stessa.

Per gli investitori, l’attenzione dovrebbe andare oltre i semplici produttori di GPU, verso quelle realtà a monte profondamente legate ai giganti e che detengono la tecnologia critica dell’ottica d’interconnessione.

Perché quando la marea si ritira e le luci delle fabbriche di calcolo si accendono, a illuminare il sistema saranno proprio queste “luci” già prenotate in anticipo.

La corsa agli armamenti sui moduli ottici è iniziata, e il colpo di pistola è stato dato proprio nel momento dell’investimento di capitale di NVIDIA. In questa gara, chi possiede la luce, possiede la velocità del futuro dell’AI.

Esclusione di responsabilità: il contenuto di questo articolo riflette esclusivamente l’opinione dell’autore e non rappresenta in alcun modo la piattaforma. Questo articolo non deve essere utilizzato come riferimento per prendere decisioni di investimento.

Ti potrebbe interessare anche

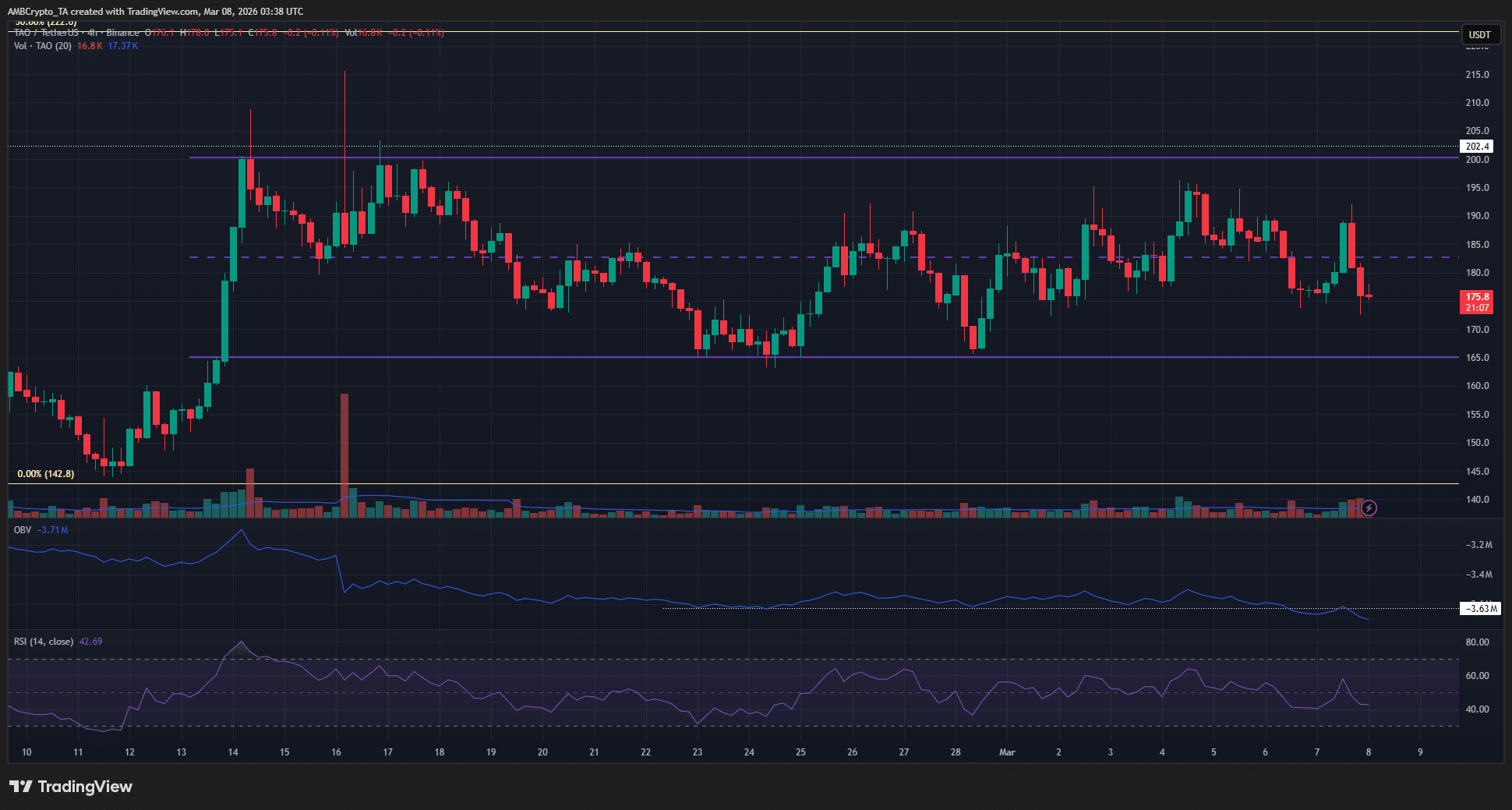

Un "bull trap" di Bitcoin si sta formando mentre il mercato ribassista entra nella fase centrale: Willy Woo

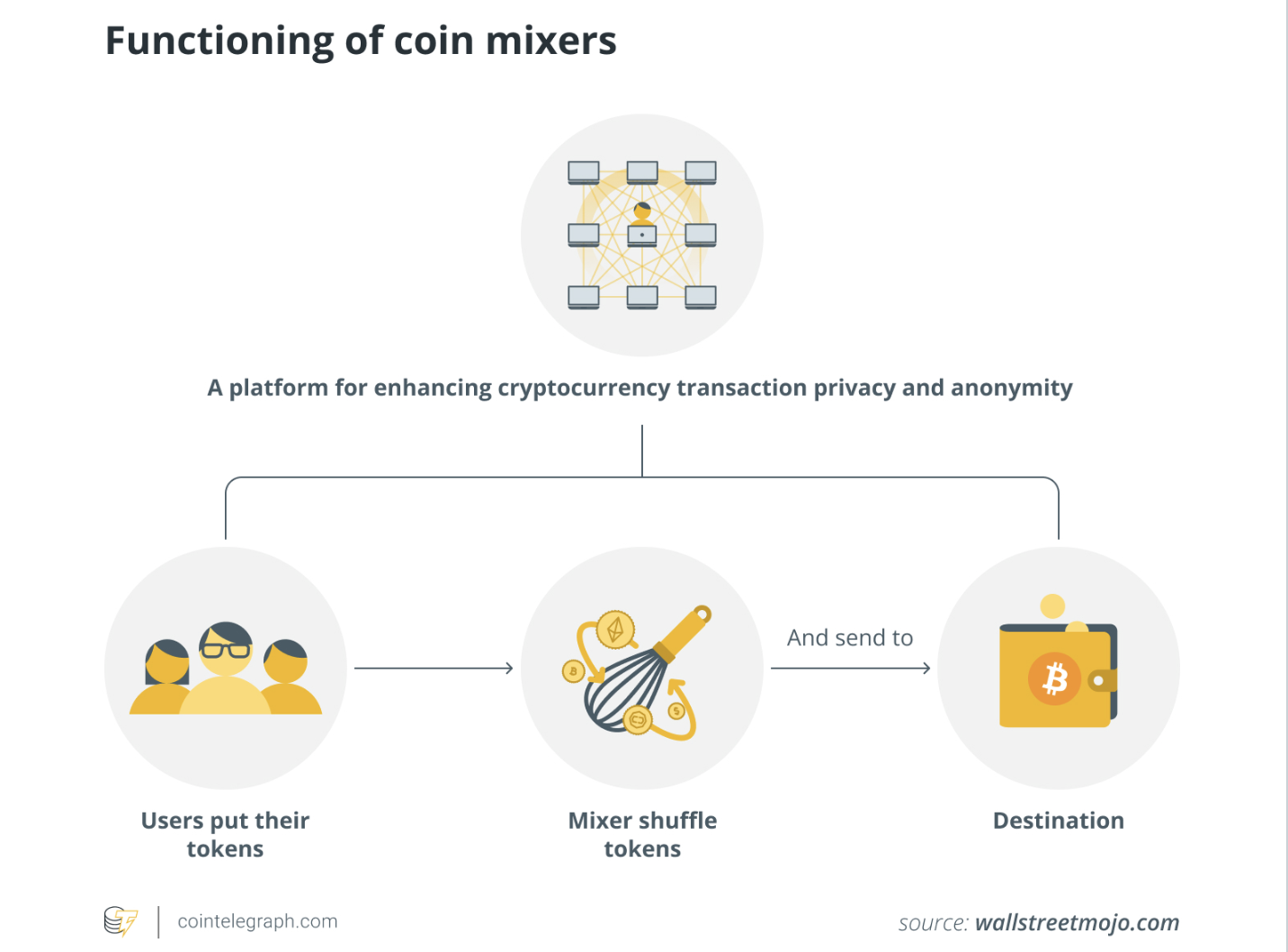

Il rapporto del Tesoro degli Stati Uniti riconosce gli usi legittimi dei crypto mixer

Il Regno Unito ha solo due giorni di scorte di gas mentre le importazioni dal Medio Oriente si fermano