Meta svela quattro nuovi processori AI, intensificando la competizione con Nvidia e AMD

Meta presenta nuovi processori AI

Meta (META) ha introdotto quattro chip AI avanzati all’interno della categoria Meta Training and Inference Accelerator (MTIA). Questa mossa fa parte della strategia di Meta di sfruttare sia GPU commerciali di Nvidia e AMD, sia l’hardware proprietario, con l’obiettivo di soddisfare le esigenze dell’AI riducendo la dipendenza da un solo fornitore.

Panoramica dei chip MTIA

- MTIA 300

- MTIA 400

- MTIA 450

- MTIA 500

Ogni chip è progettato per affrontare specifici aspetti delle operazioni AI di Meta, spaziando dai sistemi di ranking e raccomandazione a compiti di inferenza sofisticati.

MTIA 400: AI generativa e scalabilità

L’MTIA 400 è pensato per carichi di lavoro di AI generativa e ranking/raccomandazioni. Meta osserva che fino a 72 di questi chip possono essere integrati in un singolo rack di server, seguendo l’approccio visto nei rack NVL72 di Nvidia e Helios di AMD.

Meta sottolinea che l’MTIA 400 è il suo primo processore a offrire sia convenienza economica che prestazioni paragonabili ai prodotti commerciali di fascia alta, sebbene non specifichi quali prodotti siano oggetto di confronto. Nvidia e AMD sono i principali concorrenti in questo settore.

Partnership recenti

Meta ha recentemente stretto accordi a lungo termine sia con Nvidia che con AMD per la fornitura dei chip, garantendo l’accesso a più generazioni delle loro tecnologie.

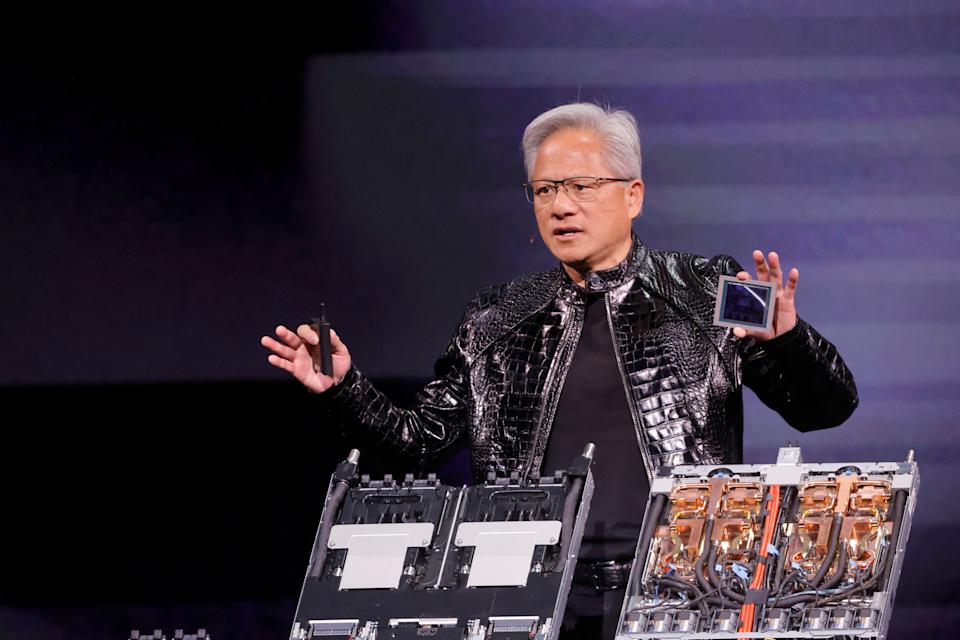

Il CEO di Nvidia, Jensen Huang, presenta una GPU Rubin durante il keynote al CES 2026 a Las Vegas. (REUTERS/Steve Marcus)

Progressi con MTIA 450 e MTIA 500

L’MTIA 450 offre una memoria ad alta larghezza di banda migliorata rispetto al suo predecessore, mentre l’MTIA 500 incrementa ulteriormente capacità e velocità della memoria.

Piani di distribuzione

Meta ha già iniziato a utilizzare alcuni di questi chip e intende distribuire i restanti modelli nel 2026 e 2027. Tutti i processori condividono un’infrastruttura unificata, consentendo aggiornamenti senza soluzione di continuità quando necessario.

Tendenze nel settore

Meta non è l’unica a sviluppare chip AI personalizzati. Google e Amazon utilizzano da tempo processori propri per training e inferenza AI, mentre Microsoft ha recentemente lanciato il chip Maia 200.

Google e Amazon forniscono inoltre i loro chip ad Anthropic per l’esecuzione di modelli AI. Secondo The Information, Google e Meta hanno firmato un accordo multimiliardario per permettere a Meta di utilizzare i processori di Google.

Impatto su Nvidia e AMD

Questo spostamento verso chip personalizzati rappresenta una sfida per Nvidia e AMD. Il CFO di Nvidia, Colette Kress, ha recentemente dichiarato che oltre la metà dei ricavi del data center della società proviene da clienti hyperscale.

Nonostante questo, Nvidia continua a registrare una crescita dei ricavi da altri clienti.

Gli hyperscaler continuano a investire nell’AI

I principali fornitori di cloud non mostrano segni di rallentamento negli investimenti in infrastrutture AI o chip di terze parti. Solo nel 2026, Amazon, Google, Meta e Microsoft si stima che destineranno insieme 650 miliardi di dollari in spese di capitale, con una parte significativa rivolta allo sviluppo dell’AI.

Iscriviti alla newsletter Week in Tech di Yahoo Finance per ricevere aggiornamenti.

Esclusione di responsabilità: il contenuto di questo articolo riflette esclusivamente l’opinione dell’autore e non rappresenta in alcun modo la piattaforma. Questo articolo non deve essere utilizzato come riferimento per prendere decisioni di investimento.

Ti potrebbe interessare anche

TXN aumenta dello 0,61% e si posiziona al 97° posto per volume di scambi dopo l'accordo di robotica con Nvidia