NVIDIA's GTC 2026: Ang Laban para sa Compute Power para sa Susunod na AI S-Curve

Nagbago na ang usapan. Dati, ito ay tungkol sa "Ano ang magagawa natin sa AI?". Ngayon, ang agarang tanong ay "Paano tayo lilipat mula sa eksperimento patungo sa tunay na epekto?". Ang pagbabagong ito ay nagpapahiwatig ng paglipat mula sa isang bagong teknolohiya patungo sa isang mahalaga at kinakailangang bahagi ng buhay. Ang pag-adopt ay naging eksponensyal. Isang nangungunang generative AI tool ang umabot na ng halos doble ng dami ng mga user kumpara sa internet sa loob ng pitong taon—sa loob lamang ng dalawang buwan. Sa kasalukuyan, mahigit 800 milyong tao ang gumagamit nitong tool linggo-linggo—katumbas ng humigit-kumulang 10% ng populasyon ng mundo. Hindi lang ito mabilis na paglago; ito ay tanda na ang teknolohiya ay umabot na sa critical mass at nagiging pundasyon na.

Nandito na tayo sa punto ng pagbabago. Kapag ang isang tool ay umabot sa ganitong antas, nagbabago ang fokus mula sa pagpapatunay na totoo ito patungo sa pagtatayo ng imprastraktura para suportahan ang epekto nito. Ang flywheel ng kumpounding innovation—mas mahusay na teknolohiya na nagbibigay-daan sa mas maraming app, gumagawa ng mas maraming data, at humihikayat ng mas maraming investment—ay nagkaroon na ng hindi mapipigilang momentum. Para sa mga negosyo, nangangahulugan itong lipas na ang mga lumang modelo. Ang mga imprastrakturang dinisenyo para sa cloud-first strategies ay hindi kayang sabayan ang ekonomiya ng AI. Ang mga prosesong ginawa para sa mga human workers ay hindi gumagana para sa mga agents. Ang mga security models na pang-perimeter defense ay hindi na protektado kontra sa mga machine-speed na banta. Tapos na ang panahon ng simpleng pag-enhance; nasa panahon na tayo ng ganap na pagbabago.

Ito ang dahilan kung bakit napakalakas ng perspektibo ni Jensen Huang. Tinawag niya ang AI bilang "essential infrastructure". Iyan ang long-term investment thesis. Kapag ang teknolohiya ay naging ka-level na ng elektrisidad o internet, ang halaga ay napupunta sa mga layer na nagpapatakbo nito—compute power, enerhiya, mga chip. Ang paglipat mula sa aplikasyon patungo sa imprastraktura ang pinakamahalagang trend sa bagong industriyal na panahon. Ang eksponensyal na S-curve ay naging plateau ng adoption, at nagsimula na ang karera upang itayo ang mga "rail" na magdadala ng susunod na alon ng inobasyon.

The Compute Power Arms Race: Mga Sukatan ng Kahusayan na Nagpapasiya ng Panalo

Ang karera para sa AI dominance ay lumampas na sa simpleng dami ng chips. Bagong larangan ngayon ang efficiency. Habang lumalaki at nagiging mas komplikado ang mga AI models, ang pangunahing limitasyon ay hindi lang compute power kundi pati ang enerhiyang kailangan upang paganahin ito. Ito ang pangunahing hamon, sa engineering at ekonomiya, na tumutukoy sa susunod na yugto ng imprastraktura. Binabago na ngayon ang mga data center mula sa simpleng mga server farm patungo sa mga high-density energy system kung saan ang kakayahang mag-imbak at magpalamig ng power ng mahusay ay pangunahing kompetisyon.

Malinaw ang pagbabago. Sa 2026, ang imprastraktura ng AI ay hindi na nasusukat sa laki lamang; ito ay tungkol sa power density, access sa enerhiya, lokasyon, resilience, predictability ng gastos, at regulasyon. Ang training at pag-deploy ng malalaking AI models ay nangangailangan ng napakalaking compute at kuryente, itinutulak sa sukdulan ang tradisyunal na disenyo ng data center at kasalukuyang mga power grid. Wala nang silbi ang lumang modelo ng pagdagdag lamang ng servers sa isang ordinaryong pasilidad. Bagong imperative na ang itayo ang mga AI factories—dedikado at mayaman sa power na mga pasilidad na estratehikong matatagpuan sa tabi ng sources ng enerhiya para mapamahalaan ang gastos at matiyak ang stability. Hindi lang ito tungkol sa mas malalaking data centers; ito ay isang pagbabago sa pananaw sa pagpaplano ng pisikal na imprastraktura para sa digital intelligence.

Ang pisikal na realidad na ito ang nagtutulak ng kasabay na ebolusyon sa compute architecture. Ang mga tema ng "AI factories" at "physical AI," na binanggit para sa GTC, ay nagmumungkahi ng hinaharap kung saan ang simulation ay hahalo na sa totoong robotics. Ang mga sistemang kayang magplano, kumilos, at umangkop sa masalimuot na kapaligiran ay nangangailangan ng bagong klase ng chips para sa bilis at efficiency—hindi lang simpleng floating-point operations. Dito papasok ang sinasabing bagong inference-focused chip, na posibleng kaugnay ng Feynman architecture. Layunin nitong patakbuhin ang agentic AI tasks—mga sistemang gumagalaw na mag-isa—on-device o sa edge, na lubos na magpapababa ng latency at dependency sa cloud. Ang makukuhang efficiency dito ay hindi lang teknikal; pang-ekonomiya rin, na nagpapababa ng kabuuang gastusin sa pagpapalawak ng AI deployment.

Sa madaling sabi, para sa mga tagapagbigay ng imprastraktura, ang gastos at predictability sa enerhiya ang nangungunang sukatan. Ang kumpanyang makakapagbigay ng pinakamaraming compute per watt, pati na ang mahusay na pamamahala ng malalaking energy demands ng mga bagong sistemang ito, ang magwawagi. Ang arms race na ito ay isinasagawa sa dalawang antas: una, sa antas ng silicon, kung saan ang mga bagong arkitektura gaya ng Feynman ang nangunguna sa efficiency; at ikalawa, sa pisikal na antas, kung saan disenyo ng data center at pinagkukunan ng enerhiya ang tumutukoy ng kakayahang mag-operate. Umabot na sa puntong ang S-curve ng pag-adopt ng AI ay ang infrastructure efficiency na lamang ang tanging daan pasulong.

Market Dominance at Mga Banta sa Kompetisyon: Ang 81% Share at ang 20% Hamon

Ang posisyon ng NVIDIA ay halos ganap na dominasyon. Hawak ng kumpanya ang 81% ng market share sa kita para sa data center chips, na nagtulak sa kanilang stock na umabot sa halaga ng $5 trillion. Hindi ito simpleng lamang; ito ay isang structural moat na binuo mula sa pinagsamang ecosystem ng hardware, networking, at foundational CUDA software platform. Resulta nito ang flywheel ng paglago, na may tumataas na sales at tubo ng higit 60% taon-taon, at ang projection na kikita ng humigit-kumulang $500 bilyon para sa 2026.

Ngunit kahit sa ganitong sukat, nagbabago na ang kompetisyon. Ang pinakamalapit na kalaban ay Advanced Micro Devices. Mabilis na lumalakas ang AMD sa kanilang Instinct accelerators at nakakuha ng $10 bilyong partnership sa OpenAI. Hindi ito malayong panganib; ito ay direktang pambabatikos sa NVIDIA, at nakukuha na ng AMD ang mga deal mula sa malalaking kliyente tulad ng Meta. Malinaw ang dynamics: NVIDIANVDA-- nagbibigay ng katatagan at patuloy na dominasyon, habang ang AMD ay alok ay mas mataas ang risk ngunit mas mataas din ang potensyal na kita para sa mga mamumuhunan na gustong samantalahin ang mabilis na paglaki ng market.

Ang mas malalim at pangmatagalang panganib ay nagmumula sa loob. Mas dumarami ang mga pangunahing tech firms na naglalaan ng resources upang magdisenyo ng in-house chips para sa sarili nilang data centers. Ang trend na ito, bunga ng pangangailangan sa cost control at customization, ay banta sa NVIDIA ecosystem lock-in sa paglipas ng panahon. Habang lumalaganap ang sariling custom silicon ng Alphabet's Google at iba pa, posibleng unti-unting mabawasan ang dependency sa NVIDIA hardware para sa core AI workloads. Ito ang klasikong "platform trap" ng infrastructure providers: ikaw ang nagtatayo ng riles, ngunit darating ang araw na ang pinakamalaking user mismo ang magtatayo ng sarili nilang daanan.

Sa buod, ang 81% share ng NVIDIA ay isang makapangyarihang kalasag, ngunit hindi ito hindi matitinag. Ang agarang hamon ay isang lehitimo at well-funded na kakompetensya sa AMD. Ang hamon sa hinaharap ay ang posibleng pag-alis ng pinakamalaking kliyente nito sa sariling solusyon. Sa ngayon, ang forecast ng kumpanya ng first-quarter sales na mas mataas sa market estimates ay nagpapakitang malakas pa rin ang demand. Ngunit nagsisimula pa lang ang arms race sa infrastructure, at nagbabago ang laro.

Catalysts, Scenarios, at Dapat Bantayan

Ang tunay na pagsubok sa imprastraktura ng NVIDIA ay darating sa GTC. Dito nasusubok kung ang theoretical S-curves ay matutugma ng totoong deployment. Ang mahahalagang anunsyo rito ang magpapatunay kung tugma ang roadmap ng kumpanya sa eksponensyal na pangangailangan ng AI industrial era. Nararapat bantayan ng mga mamumuhunan ang tatlong pangunahing katalista.

Una, ang next-generation GPU architecture. Power efficiency ang pangunahing sukatan. Habang lumalaki ang AI models, ang gastos at pisikal na limitasyon ng energy delivery ang nagiging pangunahing sagka. Anumang bagong arkitektura—pagpapahusay man ng Blackwell o pagtalon mula sa sinasabing Feynman design—ay kailangang magpakita ng malaking pag-unlad sa compute per watt. Ito ang hakbang sa efficiency na magdidikta ng economic viability ng malawakang AI factories. Ang kabiguan dito ay magpapabagsak sa naratibo ng compute arms race.

Pangalawa, ang mga sesyon tungkol sa 'agentic AI' at 'inference' ang operational signal. Ang paglipat mula sa training ng malalaking modelo patungo sa pag-deploy ng autonomous agents ang susunod na high-volume phase ng compute demand. Abangan ang konkretong demonstrasyon ng mga sistemang kayang magplano, kumilos, at umangkop sa totoong mundo. Dito papasok ang mga bagong chips na nakatuon sa inference. Ang kakayahan ng mga ito na patakbuhin ang mga kumplikadong task nang maayos on-device o sa edge ang tulay mula laboratory patungo sa tunay na epekto. Malalakas na session dito ay magsisiguro ng tuloy-tuloy na kita lampas sa initial model training.

Sa wakas, ang laki mismo ng event ay isang mahalagang palatandaan. Sa mahigit 30,000 dumadalo mula sa higit 190 bansa, ang GTC ay live na barometro ng global infrastructure build-out. Hindi lamang ito developer conference; isa itong workforce mobilization event. Ang mga session para sa training, certification, at startup engagement ay nagpapakita ng napakalaking human capital na kailangan para suportahan ang paglawak ng AI. Pinapatunayan ng attendance figure na ang AI ay nagiging mahalagang imprastruktura na kailangan ng bagong industriyal na deployment ng talento at pisikal na sistema.

Sa madaling sabi, ang GTC ang magpapakita kung ang NVIDIA ay simpleng vendor lang o ang di-mapapalitang tagapagpatakbo ng bagong industriyal na panahon. Ang mga anunsyo ng efficiency, mga practical na demo ng agentic systems, at laki ng partisipasyon ang sama-samang magdedesisyon kung ang dominasyon ng kumpanya ay lalong titibay o mamamayani na ang mga bagong kakompetensya sa susunod na S-curve.

Disclaimer: Ang nilalaman ng artikulong ito ay sumasalamin lamang sa opinyon ng author at hindi kumakatawan sa platform sa anumang kapasidad. Ang artikulong ito ay hindi nilayon na magsilbi bilang isang sanggunian para sa paggawa ng mga desisyon sa investment.

Baka magustuhan mo rin

Sa Loob ng Misyon ng Colossus na Palitan ang Visa at Mastercard ng Crypto Cards na Walang KYC

Nawala ng XRP ang Kabuuang Basehan ng Gastos ng mga May-Hawak. Narito kung Bakit Ito Mapanganib

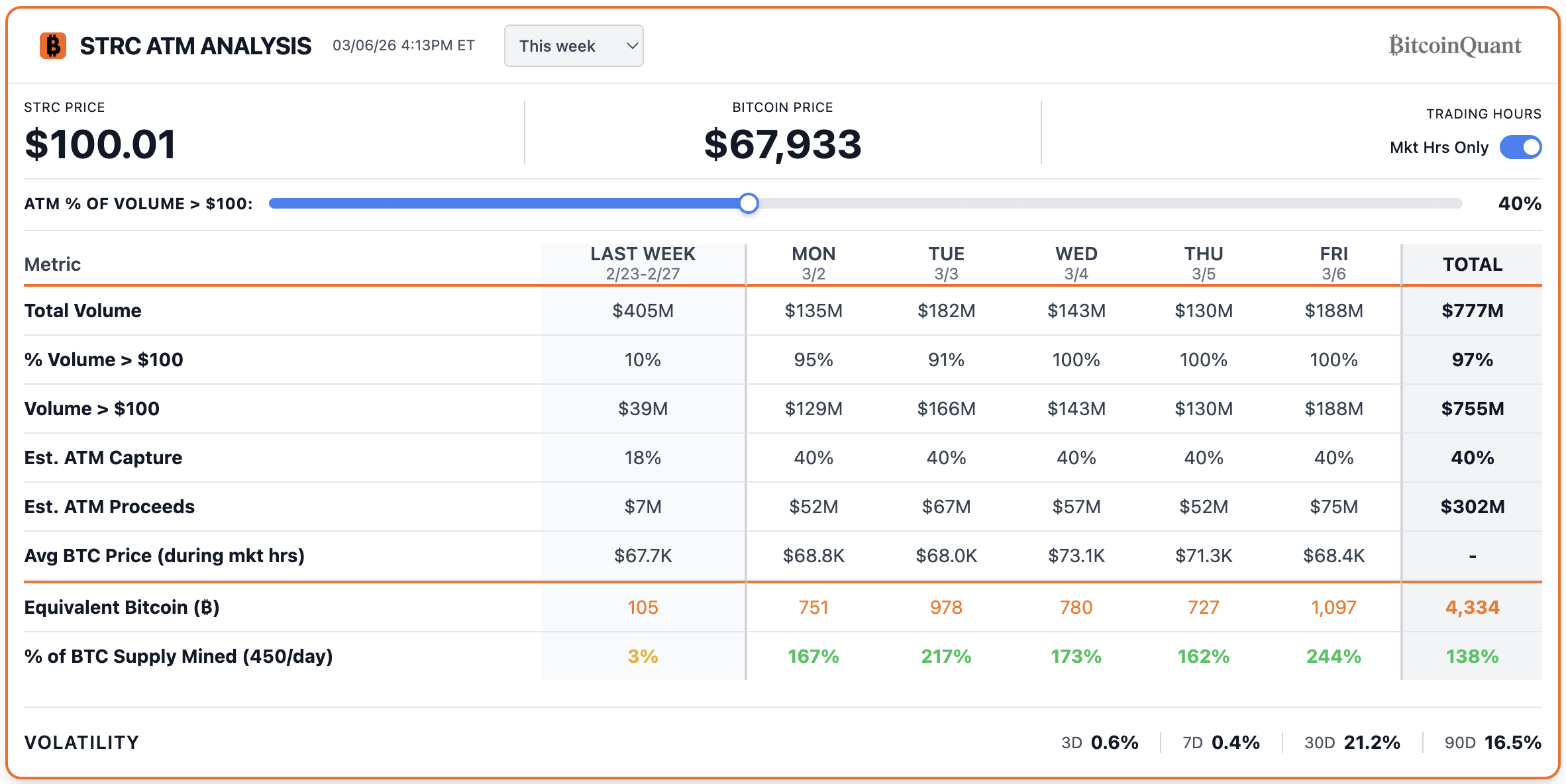

Pagtaas ng kalakalan ng stock ng Strategy's STRC: Gaano karaming Bitcoin ang kayang bilhin ni Saylor?