Meta inilunsad ang apat pang dagdag na AI processor, pinatindi ang kompetisyon laban sa Nvidia at AMD

Meta Inilunsad ang mga Bagong AI Processors

Ang Meta (META) ay nagpakilala ng apat na advanced AI chips sa ilalim ng kanilang Meta Training and Inference Accelerator (MTIA) lineup. Bahagi ito ng estratehiya ng Meta upang pagsabayin ang paggamit ng commercial GPUs mula sa Nvidia at AMD pati na rin ang kanilang sariling hardware, na layuning matugunan ang AI requirements at mabawasan ang pag-asa sa iisang supplier.

Pangkalahatang-ideya ng MTIA Chips

- MTIA 300

- MTIA 400

- MTIA 450

- MTIA 500

Bawat chip ay iniangkop upang tugunan ang partikular na aspeto ng AI operations ng Meta, mula sa ranking at recommendation systems hanggang sa mga mas sopistikadong inferencing tasks.

MTIA 400: Generative AI at Scalability

Ang MTIA 400 ay dinisenyo para sa generative AI at mga ranking/recommendation workload. Binanggit ng Meta na hanggang 72 ng mga chip na ito ay maaaring pagsama-samahin sa isang server rack, kahalintulad ng estratehiya sa mga rack ng Nvidia NVL72 at AMD Helios.

Itinatampok ng Meta na ang MTIA 400 ang kanilang unang processor na nagdadala ng parehong cost efficiency at performance na maikukumpara sa mga nangungunang commercial products, bagaman hindi tinukoy kung aling mga produkto ang binabanggit. Sina Nvidia at AMD ang pangunahing mga kakompetisyon sa larangang ito.

Kamakailang mga Pakikipag-partner

Kamakailan, pumirma ang Meta ng mga pangmatagalang kasunduan sa parehong Nvidia at AMD ukol sa suplay ng chips, upang matiyak ang access sa iba't ibang henerasyon ng kanilang teknolohiya.

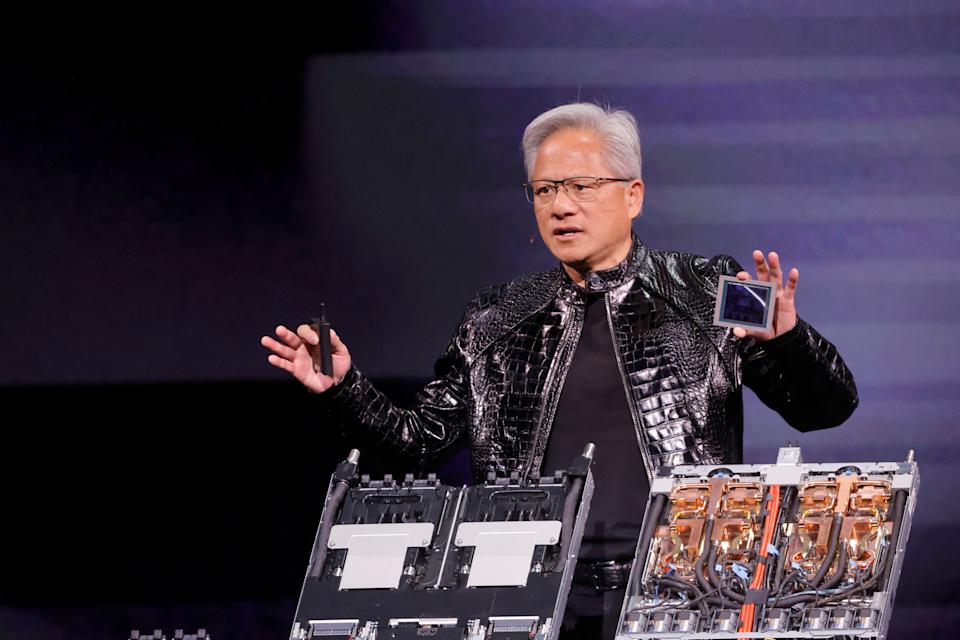

Ipinapakita ni Nvidia CEO Jensen Huang ang isang Rubin GPU sa keynote sa CES 2026 sa Las Vegas. (REUTERS/Steve Marcus)

Mga Pag-unlad gamit ang MTIA 450 at MTIA 500

Ang MTIA 450 ay nag-aalok ng pinahusay na high-bandwidth memory kumpara sa naunang modelo, habang ang MTIA 500 ay nagpapalawak pa ng memory capacity at bilis.

Mga Plano para sa Deployment

Nagsimula na ang Meta na gamitin ang ilan sa mga chips na ito at balak nilang ilunsad ang natitirang mga modelo sa 2026 at 2027. Pare-pareho ng imprastraktura ang lahat ng processors, kaya’t madali ang pag-upgrade ayon sa pangangailangan.

Mga Uso sa Industriya

Hindi lang ang Meta ang gumagawa ng sarili nilang AI chips. Matagal nang ginagamit ng Google at Amazon ang sarili nilang processors para sa AI training at inference, habang kamakailan ay inilunsad ng Microsoft ang Maia 200 chip nito.

Pati ang Google at Amazon ay nagbibigay rin ng kanilang chips sa Anthropic para sa pagpapatakbo ng AI models. Ayon sa The Information, pumirma ang Google at Meta ng multi-bilyong dolyar na kasunduan para gamitin ng Meta ang processors ng Google.

Epekto sa Nvidia at AMD

Ang paglilipat patungo sa custom chips ay nagdudulot ng mga hamon para sa Nvidia at AMD. Kamakailan ay sinabi ni Nvidia CFO Colette Kress na mahigit kalahati ng revenue ng kumpanya mula sa data center ay galing sa hyperscale clients.

Sa kabila nito, patuloy pa ring tumataas ang kita ng Nvidia mula sa iba pang customer.

Patuloy ang Pamumuhunan ng mga Hyperscaler sa AI

Wala pang senyales ang mga pangunahing cloud provider na babawasan nila ang pamumuhunan sa AI infrastructure o third-party chips. Sa 2026 lamang, inaasahang aabot sa $650 bilyon ang sama-samang capital expenditures ng Amazon, Google, Meta, at Microsoft, kung saan malaking bahagi ay nakalaan sa pag-unlad ng AI.

Mag-subscribe sa Yahoo Finance's Week in Tech newsletter para sa mga update.

Disclaimer: Ang nilalaman ng artikulong ito ay sumasalamin lamang sa opinyon ng author at hindi kumakatawan sa platform sa anumang kapasidad. Ang artikulong ito ay hindi nilayon na magsilbi bilang isang sanggunian para sa paggawa ng mga desisyon sa investment.

Baka magustuhan mo rin

Ang OXT ay nagtala ng 54.5% na pagbabago sa loob ng 24 oras: Walang malinaw na 24h event-driven na dahilan