SK Hynix zabezpiecza 2/3 dostaw HBM4 dla Nvidia — dlaczego taki podział wskazuje na długoterminową dominację w infrastrukturze AI

Kolejna faza krzywej S dla obliczeń AI opiera się na jednej, kluczowej warstwie infrastruktury: pamięci o wysokiej przepustowości. Przydział Nvidia dla platformy Vera Rubin stanowi wyraz zaufania do firm, które potrafią zbudować tę warstwę na dużą skalę. Celem jest nie tylko większa ilość pamięci, lecz gigantyczny skok w przepustowości. System rackowy VR200 NVL72 został zaprojektowany tak, aby osiągnąć ponad 22 terabajty na sekundę przepustowości systemowej, liczba ta odzwierciedla wykładniczy popyt na przesyłanie danych do i z akceleratorów AI. To nie jest stopniowa poprawa; to zmiana paradygmatu w intensywności pamięci.

Wygrana na tej nowej generacji infrastruktury to wyścig o stabilną, wysokowydajną masową produkcję, a nie tylko czystą konkurencję technologiczną. Przydział Nvidia — około dwie trzecie jej zapotrzebowania na HBM4 skierowano do SK Hynix, resztę do Samsung — odzwierciedla nowe kalkulacje. Decyzja jest wyrazem zaufania do utrwalonych partnerstw SK Hynix i, co ważniejsze, udowodnionej zdolności tej firmy do dostaw na dużą skalę. Analitycy wskazują, że ten ruch oznacza zaufanie do długoletnich relacji SK Hynix w zakresie HBM oraz wiarygodności uzyskanej na bazie stale wysokiej wydajności masowej produkcji. SK Hynix miało już wdrożony system masowej produkcji HBM4 i dostarczyło zweryfikowane próbki, co jest warunkiem pełnoskalowej produkcji.

Dla Samsung przydział stanowi kontratak. Firma celuje w maksymalną wydajność dzięki zaawansowanemu procesowi i zapewniła sobie oficjalne dostawy HBM4 już w przyszłym miesiącu do głównych klientów chipów AI takich jak NVIDIANVDA-3.01%. To, że obaj dostawcy obecnie oferują dostawy w podobnych cenach, sygnalizuje, że rynek przekracza prostą konkurencję kosztową. Główną przewagą konkurencyjną staje się zdolność do niezawodnego zwiększania produkcji i realizacji agresywnych harmonogramów budowniczych platform AI.

Najważniejsze jest to, że HBM4 reprezentuje najwyższy przychód i największą marżę na zawartości pamięci w tych systemach. Wykluczenie z tej warstwy oznacza pozostanie w tyle względem wykładniczego wzrostu. Dla dostawców jest to ostra alternatywa: opanować złożoną, wysokowydajną produkcję wymaganą dla kolejnego paradygmatu lub zostać zepchniętym do segmentów o niższej wartości. Przydział Nvidia jasno wskazuje, gdzie są układane tory.

Konkurencyjna przewaga: moc produkcyjna, wydajność i kwalifikacja techniczna

Wyścig o dominację HBM4 odbywa się na konkretnych płaszczyznach skali, siły finansowej i kwalifikacji technicznej. SK Hynix i Samsung mają decydującą przewagę nad Micron, nie tylko pod względem ambicji, ale także aktualnego wykonania i pozycji rynkowej.

Pod względem finansowym, dominacja SK Hynix jest jasna. Firma odnotowała rekordowy zysk operacyjny w wysokości 47,2 biliona wonów za cały rok, przewyższając Samsung, który uzyskał 43,6 biliona wonów. To nie tylko kwartalna przewaga; to odzwierciedlenie skoncentrowanego, napędzanego AI modelu biznesowego. Podczas gdy Samsung działa w dziedzinie elektroniki konsumenckiej i produkcji kontraktowej, SK Hynix skupia się wyłącznie na chipach pamięci, co pozwoliło mu zająć najbardziej dochodowy segment boomu AI. Ta siła finansowa napędza agresywną ekspansję firmy, która planuje zwiększyć inwestycje w infrastrukturę ponad czterokrotnie w stosunku do poprzedniego poziomu. Samsung podąża tą samą drogą, zamierzając rozszerzyć swoją moc produkcyjną o około 50 procent w 2026 roku. Obydwie firmy budują nowe fabryki, ale skala inwestycji SK Hynix sygnalizuje zaangażowanie w zabezpieczenie przewagi podczas zbliżającego się kryzysu pojemności.

Techniczna przeszkoda dla platformy Vera Rubin firmy Nvidia to ostatni, kluczowy filtr. Firma wymaga od HBM4 szybkości przesyłania danych, które przekraczają 10Gb/s, co stanowi znaczący skok względem standardowych 8Gb/s. Tutaj rozgrywa się najostrzejsza konkurencja. Raporty branżowe wskazują, że Samsung skutecznie przeszedł testy kwalifikacyjne HBM4 firmy NVIDIA przy tych wysokich prędkościach. SK Hynix nadal optymalizuje swój produkt, aby sprostać najbardziej wymagającym kryteriom. Dla Micron, różnica jest większa. Chociaż firma ma dostarczać HBM4 do akceleratorów średniej klasy, nie spełniła wymagań kwalifikacyjnych dla flagowej platformy Vera Rubin. Ta kwalifikacja techniczna jest bramą do najbardziej dochodowych, najwyżej wydajnych systemów.

Ostateczny wniosek jest taki, że SK Hynix i Samsung budują tory dla kolejnego paradygmatu AI, podczas gdy Micron kierowany jest na tor niższej klasy. Ich wspólne plany na ekspansję mocy produkcyjnej, wspierane rekordowymi zyskami, mają zaspokoić wykładniczy popyt. Kwalifikacja techniczna dla Vera Rubin to pierwszy znaczący test gotowości, a obecne dowody wskazują, że dwie koreańskie firmy wyprzedzają konkurencję.

Zwrot Micron i alternatywa LPDDR5X

Strategiczne przeorientowanie Micron jest bezpośrednią odpowiedzią na wykluczenie z HBM4. W grudniu 2025 roku firma ogłosiła plany wycofania się z rynku pamięci i pamięci masowej dla konsumenta, aby skoncentrować zasoby na klientach z sektora AI i centrów danych. Ten zwrot to klasyczne podwojenie zakładu na wykładniczej krzywej wzrostu, lecz firma porusza się po innym torze — o zasadniczo mniejszej przepustowości i znaczeniu ekonomicznym.

Kluczowy problem dotyczy architektury systemu i ekonomii. LPDDR5X, które Micron dostarcza dla procesorów Vera firmy Nvidia, działa w zupełnie innym poziomie stosu pamięci. Jest to rozwiązanie o niskim poborze mocy, zorientowane na koszt, zaprojektowane dla zadań mobilnych i podstawowych serwerów. Dla kontrastu, HBM4 jest szkieletowym rozwiązaniem o wysokiej przepustowości i wysokiej marży, stanowiącym bazę systemów AI nowej generacji. Różnica ekonomiczna jest znacząca: HBM generuje bardzo wysokie przychody na jednostkę i zdecydowanie wyższe marże niż konwencjonalna DRAM, a LPDDR5X plasuje się jeszcze niżej na tej drabinie wartości. Dla systemu takiego jak VR200 NVL72 rack, którego celem jest ponad 22 terabajty na sekundę przepustowości, LPDDR5X po prostu nie jest w stanie sprostać wymaganiom, zajmuje inne miejsce w architekturze systemu, nie jako konkurencyjne rozwiązanie.

To prowadzi bezpośrednio do prawdopodobieństwa niepowodzenia kwalifikacji. Skrajne wymagania dotyczące przepustowości platformy Vera Rubin, napędzane przez jej konstrukcję z 72 GPU, faworyzują HBM wobec wszelkich alternatyw. Raportowane przez Micron problemy z wydajnością i osiągami podczas rozwoju HBM4 prawdopodobnie spowolniły kwalifikację względem SK Hynix i Samsung, którzy już zyskali projekty. Biorąc pod uwagę, że podaż HBM4 dla tej platformy jest podzielona między te dwie firmy, z około 70-procentowym udziałem dla SK hynix, ścieżka dla Micron do dołączenia do flagowych systemów Vera Rubin wydaje się zamknięta. Jego rola w LPDDR5X jest wspomagająca, nie fundamentalna pod względem wydajności.

Ostateczny wniosek dla Micron jest bolesną wymianą. Rezygnując z rynku konsumenckiego, firma koncentruje kapitał i inżynierię na centrum danych AI, lecz została wykluczona z najbardziej wartościowego segmentu tego rynku. Dostawy LPDDR5X stanowią stabilny, rosnący biznes, lecz to gra o niskiej marży i przepustowości, która nie uczestniczy w wykładniczym skalowaniu przepustowości paradygmatu Vera Rubin. W wyścigu o infrastrukturę AI, pozostanie w tyle na torze HBM4 oznacza relegację na inny, mniej lukratywny tor.

Katalizatory, scenariusze i co obserwować

Natychmiastowy test dla dominacji SK Hynix i Samsung w zakresie HBM4 rozpoczyna się w tym miesiącu. Ponieważ produkcja HBM4 trwa ponad sześć miesięcy od wafla do finalnego opakowania, oczekuje się, że obie firmy rozpoczną produkcję już w tym miesiącu. Kluczowe wskaźniki to wydajność i limity mocy produkcyjnej. Samsung już rozpoczął dostawy w lutym, co daje mu niewielką przewagę. SK Hynix, jeszcze optymalizując swój produkt do najbardziej wymagających 11Gb/s, musi teraz udowodnić, że potrafi niezawodnie zwiększyć produkcję. Każde potknięcie w wydajności lub mocy będzie bezpośrednim wyzwaniem dla tezy o stabilnej, wysokowydajnej masowej produkcji.

Patrząc w przyszłość na rok 2026, prognoza udziału w rynku pokazuje jasną, choć mniej dominującą, przewagę SK Hynix. Według TrendForce, firma ma przechwycić 50% globalnej produkcji bitów HBM, co stanowi spadek z 59% udziału w 2025 roku. Udział Samsung ma wzrosnąć z 20% do 28%. Ta zmiana podkreśla dynamikę konkurencji: SK Hynix pozostaje liderem pod względem wolumenu, ale Samsung zdobywa teren, szczególnie na flagowej platformie Vera Rubin. Kluczowe ryzyko dla tego układu polega na tym, czy problemy z wydajnością lub ograniczenia mocy produkcyjnej u którejkolwiek firmy stwarzają tymczasową okazję dla LPDDR5X firmy Micron w niszowych zastosowaniach. Mimo że LPDDR5X nie może sprostać ekstremalnym wymaganiom przepustowości racka VR200 NVL72, może znaleźć miejsce w akceleratorach inferencyjnych średniego poziomu, ponieważ Micron ma dostarczać Rubin CPX platformę.

Podsumowując, najbliższe miesiące pokażą, czy SK Hynix i Samsung potrafią przekuć kwalifikacje techniczne i siłę finansową w bezbłędną, szeroko zakrojoną produkcję. Katalizatorem jest sam proces zwiększania produkcji. Sukces oznacza utrwalenie ich pozycji jako jedynych torów dla nowego paradygmatu AI. Porażka otwiera drzwi, choćby wąskie, dla alternatywnych rozwiązań. Na tę chwilę wykładnicza krzywa wzrostu pozostaje zdecydowanie w ich rękach.

Zastrzeżenie: Treść tego artykułu odzwierciedla wyłącznie opinię autora i nie reprezentuje platformy w żadnym charakterze. Niniejszy artykuł nie ma służyć jako punkt odniesienia przy podejmowaniu decyzji inwestycyjnych.

Może Ci się również spodobać

Transakcje napędzane impetem szybko się odwracają, gdy na świecie następuje spadek rynku

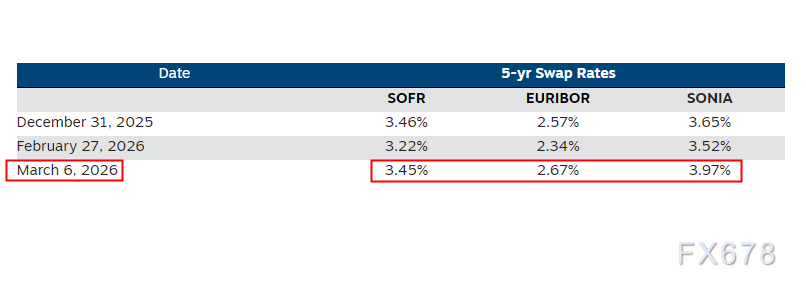

Wojna przepisuje zasady dotyczące stóp procentowych, stawka swap ujawnia tempo wojny

Około 36,8 miliarda XRP znajduje się obecnie pod wodą. Oto, co to oznacza

Czy Dodge & Cox International Stock (DODFX) jest obecnie najlepszym wyborem wśród funduszy inwestycyjnych?