Nvidia lança nova geração da plataforma Rubin, com custo de inferência 10 vezes menor que Blackwell, prevista para ser enviada no segundo semestre

A Nvidia lançou a nova geração da plataforma Rubin AI na CES, marcando sua manutenção no ritmo anual de atualizações no setor de chips de inteligência artificial (IA). A plataforma, que integra seis novos chips, traz avanços significativos em custo de inferência e eficiência de treinamento, e as primeiras entregas aos clientes ocorrerão no segundo semestre de 2026.

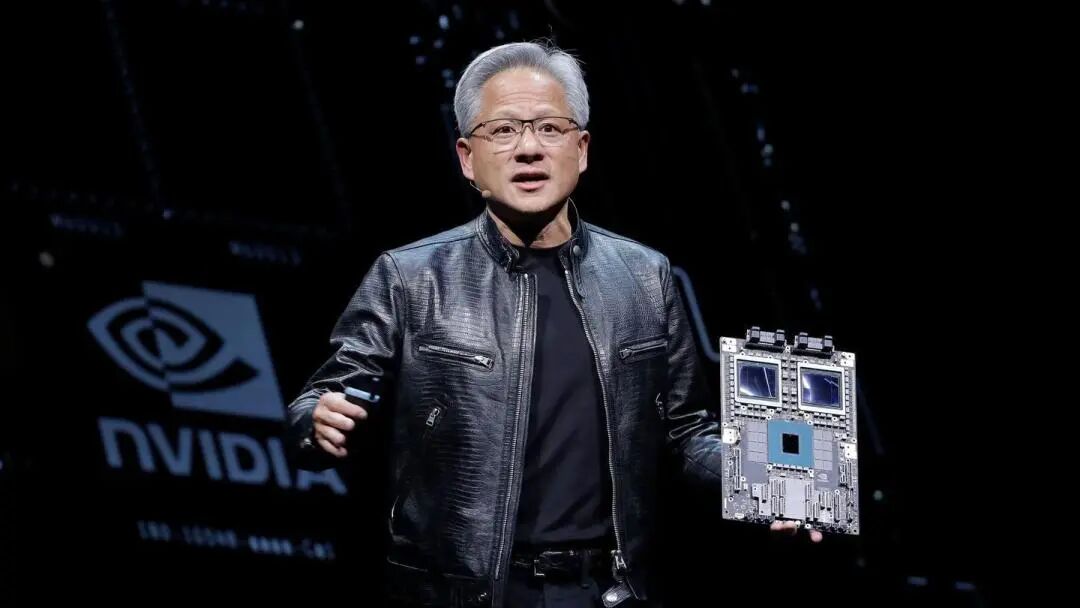

No dia 5, segunda-feira, horário da Costa Leste dos EUA, o CEO da Nvidia, Jensen Huang, declarou em Las Vegas que os seis chips Rubin retornaram das fabricantes parceiras, já passaram por testes críticos e o processo segue conforme o plano. Ele observou que “a corrida da IA já começou, todos estão se esforçando para alcançar o próximo nível”. A Nvidia destacou que os sistemas baseados em Rubin terão custos operacionais inferiores aos da versão Blackwell, pois alcançam os mesmos resultados com menos componentes.

A Microsoft e outros grandes provedores de computação em nuvem serão os primeiros clientes a implementar o novo hardware no segundo semestre. A próxima geração da superfábrica de IA Fairwater da Microsoft contará com o sistema em rack Nvidia Vera Rubin NVL72, podendo ser ampliado para centenas de milhares de superchips Vera Rubin da Nvidia. A CoreWeave também estará entre os primeiros fornecedores a oferecer sistemas Rubin.

O lançamento da plataforma ocorre em meio a preocupações de parte de Wall Street sobre o aumento da concorrência enfrentada pela Nvidia e dúvidas sobre a sustentabilidade do ritmo atual de investimentos em IA. No entanto, a Nvidia mantém uma perspectiva otimista de longo prazo, estimando o mercado total em trilhões de dólares.

Melhorias de desempenho voltadas para a nova geração de IA

Segundo comunicado da Nvidia, o desempenho de treinamento da plataforma Rubin é 3,5 vezes maior que o da geração anterior Blackwell, e o desempenho na execução de softwares de IA é 5 vezes superior. Em comparação à plataforma Blackwell, a Rubin pode reduzir em até 10 vezes o custo de geração de tokens de inferência e em 4 vezes o número de GPUs necessárias para treinar modelos de especialistas mistos (MoE).

A nova plataforma conta com a CPU Vera, que possui 88 núcleos e desempenho duas vezes superior ao de produtos substitutos. Essa CPU é projetada especificamente para inferência de agentes, sendo o processador mais eficiente em larga escala para fábricas de IA, com 88 núcleos Olympus customizados, compatibilidade total com Armv9.2 e conexão ultrarrápida NVLink-C2C.

A GPU Rubin está equipada com a terceira geração do mecanismo Transformer, com compressão adaptativa acelerada por hardware, entregando 50 petaflops de capacidade de computação NVFP4 para inferência de IA. Cada GPU oferece largura de banda de 3,6 TB/s, enquanto o rack Vera Rubin NVL72 chega a 260 TB/s de largura de banda.

Avanço nos testes dos chips

Jensen Huang revelou que todos os seis chips Rubin retornaram dos parceiros de fabricação e já passaram por testes críticos, demonstrando que podem ser implementados conforme o cronograma. Isso reforça a posição da Nvidia como fabricante líder de aceleradores de IA.

A plataforma inclui cinco tecnologias inovadoras: a sexta geração da tecnologia de interconexão NVLink, mecanismo Transformer, computação confidencial, mecanismo RAS e CPU Vera. Entre elas, a terceira geração da tecnologia de computação confidencial faz do Vera Rubin NVL72 o primeiro rack a oferecer proteção de dados entre domínios de CPU, GPU e NVLink.

O mecanismo RAS de segunda geração cobre GPU, CPU e NVLink, oferecendo verificações de integridade em tempo real, tolerância a falhas e manutenção proativa para maximizar a produtividade do sistema. O rack adota design modular e sem bandejas de cabos, tornando a montagem e manutenção 18 vezes mais rápidas do que o Blackwell.

Amplo suporte do ecossistema

A Nvidia afirmou que, em 2026, Amazon AWS, Google Cloud, Microsoft e Oracle Cloud serão as primeiras a implementar instâncias baseadas na Vera Rubin, seguidas pelas parceiras de nuvem CoreWeave, Lambda, Nebius e Nscale.

O CEO da OpenAI, Sam Altman, declarou: “A inteligência se expande com a computação. À medida que aumentamos a capacidade computacional, os modelos se tornam mais poderosos, capazes de resolver problemas mais complexos e gerar maior impacto para as pessoas. A plataforma Rubin da Nvidia nos ajuda a sustentar esse avanço.”

Dario Amodei, cofundador e CEO da Anthropic, afirmou que a “eficiência aprimorada da plataforma Rubin da Nvidia representa um avanço de infraestrutura que possibilita memórias mais longas, melhores inferências e saídas mais confiáveis”.

O CEO da Meta, Mark Zuckerberg, afirmou que a “plataforma Rubin da Nvidia promete mudanças revolucionárias em desempenho e eficiência, necessárias para levar os modelos mais avançados a bilhões de pessoas”.

A Nvidia também disse que Cisco, Dell, HPE, Lenovo e Supermicro devem lançar servidores de vários tipos baseados nos produtos Rubin. Laboratórios de IA como Anthropic, Cohere, Meta, Mistral AI, OpenAI e xAI aguardam utilizar a plataforma Rubin para treinar modelos ainda maiores e mais avançados.

Divulgação antecipada dos detalhes do produto

Segundo comentários, neste ano a Nvidia revelou detalhes dos novos produtos mais cedo do que o habitual, como parte de sua estratégia para manter o setor dependente de seu hardware. Normalmente, a Nvidia apresenta detalhes dos produtos em profundidade durante o evento GTC realizado na primavera em San Jose, Califórnia.

Para Jensen Huang, a CES foi apenas mais uma etapa em sua maratona de participações em eventos. Ele anuncia produtos, parcerias e investimentos em todos eles, com o objetivo de impulsionar a implementação de sistemas de IA.

O novo hardware divulgado pela Nvidia inclui também componentes de rede e conectividade, que farão parte do supercomputador DGX SuperPod, mas também poderão ser adquiridos separadamente para uso mais modular pelos clientes. Esse aumento de desempenho é fundamental, pois a IA está migrando para redes de modelos mais especializadas, que não apenas filtram grandes volumes de dados de entrada, mas também resolvem problemas específicos por meio de processos em múltiplas etapas.

A Nvidia está promovendo a aplicação da IA em toda a economia, incluindo robótica, saúde e indústria pesada. Como parte desse esforço, anunciou uma série de ferramentas para acelerar o desenvolvimento de carros autônomos e robôs. Atualmente, a maior parte dos investimentos em computação baseada na Nvidia vem do orçamento de despesas de capital de alguns poucos clientes, incluindo Microsoft, Google Cloud, da Alphabet, e AWS, da Amazon.

Aviso Legal: o conteúdo deste artigo reflete exclusivamente a opinião do autor e não representa a plataforma. Este artigo não deve servir como referência para a tomada de decisões de investimento.

Talvez também goste

Taiwan: TWD fortalecido pelo desempenho das exportações e influxos de capital – Commerzbank

Baleia de cripto perde quase $50 milhões ao trocar USDT por AAVE

A 'Crypto Mom' da SEC pede regras de divulgação mais simples e destaca debate sobre tokenização

Quest Resource (NASDAQ:QRHC) fica aquém das projeções de receita do quarto trimestre do ano fiscal de 2025