Relatório mais recente de semicondutores do Morgan Stanley: o ciclo de poder computacional em IA está se expandindo para armazenamento e encapsulamento

Em 5 de março de 2026, Morgan Stanley divulgou um relatório de pesquisa sobre a indústria de semicondutores asiática:

《Greater China Semiconductors – Bullish on Cloud, Memory and Optical Outlook; Accumulating Ahead of GTC》.

O relatório aponta que o principal motor do setor de semicondutores continua sendo a construção de infraestrutura de inteligência artificial, mas o foco do mercado está mudando.

Se o ciclo de IA de 2023–2024 foi principalmente centrado em GPU, entrando em 2025–2026, a demanda de IA começa a se espalhar por toda a cadeia da indústria de semicondutores, incluindo:

Memórias (Memory)

Embalagem avançada (Advanced Packaging)

Chips ASIC personalizados

Rede de data centers

A conclusão de Morgan Stanley é:

O investimento em poder computacional de IA ainda está em fase de expansão, e o setor de semicondutores está entrando em um novo ciclo de demanda estrutural.

1. Os gastos de capital das empresas de nuvem continuam crescendo

A demanda central por semicondutores de IA ainda vem dos provedores de computação em nuvem.

Dados da Morgan Stanley mostram:

No quarto trimestre de 2025, os investimentos de capital dos quatro maiores provedores de nuvem globais (Amazon, Microsoft, Google, Meta) cresceram 64% em relação ao ano anterior.

Ao expandir para os dez maiores provedores de nuvem globais, Morgan Stanley prevê:

Em 2026, os gastos globais de capital em computação em nuvem chegarão a quase 685 bilhões de dólares.

Em previsões de longo prazo, o CEO da NVIDIA, Jensen Huang, propôs:

O investimento global em infraestrutura de IA pode chegar a 1 trilhão de dólares até 2028.

Essa tendência significa:

A construção de infraestrutura de IA ainda está em um ciclo de expansão, e não em um estágio de pico, como preocupa o mercado.

2. A inferência de IA está mudando a estrutura da demanda de memória

Morgan Stanley acredita que o componente mais subestimado neste ciclo de IA éa demanda por memória.

Modelos de inferência de IA precisam armazenar grandes volumes de dados de contexto (Context Memory),

impulsionando assim novas necessidades de arquitetura de armazenamento.

O relatório propõe um conceito:

ICMS (Inference Context Memory Storage)

Ou seja, um sistema de armazenamento especialmente para contextos de inferência de IA.

Segundo cálculos da Morgan Stanley:

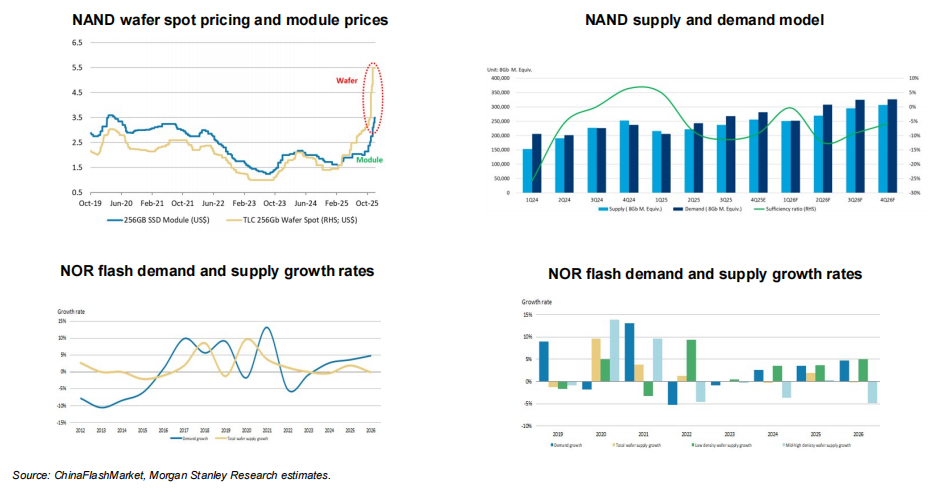

Até 2027, a demanda por inferência de IA consumirá adicionalmente 13% da demanda global por memória NAND.

Ao mesmo tempo, o mercado de NOR Flash pode entrar em um estado de oferta restrita.

O relatório aponta:

A demanda por memória de IA pode reacender o ciclo ascendente da indústria de armazenamento.

3. HBM se torna o principal gargalo do poder de IA

Um dos principais fatores para melhorar o desempenho dos chips de IA é o armazenamento de alta largura de banda (HBM).

Morgan Stanley prevê:

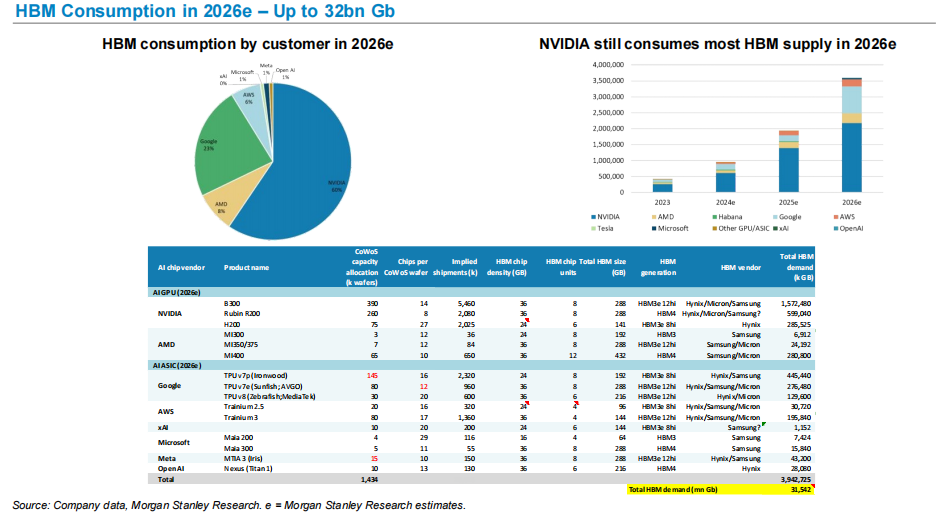

Em 2026, a demanda global por HBM pode chegar a cerca de 32 bilhões de Gb.

Na estrutura de demanda:

A NVIDIA ainda é o maior consumidor de HBM.

A demanda rápida de AI GPU e chips AI ASIC por HBM faz dele um recurso chave na cadeia de fornecimento de computação de IA.

Esta tendência explica também por que:

SK Hynix

Micron

Samsung

Destacam-se neste ciclo de IA.

4. Embalagem avançada se torna gargalo da produção de chips de IA

AI GPUs não só exigem processos avançados, mas dependem fortemente de embalagens avançadas.

Morgan Stanley prevê:

A capacidade de embalagem avançada CoWoS da TSMC pode aumentar para 125 mil wafers por mês em 2026.

A demanda principal vem de:

NVIDIA

AMD

Chips AI próprios de grandes empresas de nuvem

A embalagem avançada tornou-se assim um gargalo importante na cadeia de suprimentos de chips de IA.

5. AI ASIC está crescendo rapidamente

Além da GPU, provedores de nuvem estão desenvolvendo chips AI próprios em grande escala.

Atualmente os principais projetos incluem:

Google TPU

Amazon Trainium

Microsoft Maia

Meta MTIA

Morgan Stanley prevê que nos próximos anos o volume de vendas de AI ASIC continuará a crescer.

Por exemplo:

A série de chips AWS Trainium terá seu volume de vendas continuamente ampliado nos próximos anos.

Isso significa que o mercado de poder computacional de IA mostrará:

Uma estrutura de desenvolvimento paralelo GPU + ASIC.

6. Substituição de AI GPU na China está avançando

O relatório também faz previsões para a indústria de chips AI da China.

Morgan Stanley prevê:

A taxa de autossuficiência dos GPU na China aumentará de 34% em 2024 para 50% em 2027.

Além disso, o tamanho do mercado de IA em nuvem da China deverá atingir em 2027:

cerca de 48 bilhões de dólares.

Isso significa que a cadeia global de poder computacional de IA está passando por uma certa regionalização estrutural.

Meu entendimento

Se o relatório for resumido em uma frase, na verdade é muito simples:

O ciclo dos semicondutores de IA está se espalhando do “poder computacional” para “toda a cadeia de suprimentos”.

No início, o mercado focou nos GPU.

Mas com a expansão da infraestrutura de IA, a demanda está se espalhando para:

Memórias

Embalagem avançada

Chips de rede

ASIC personalizados

Isso indica:

IA não é mais apenas um ciclo de chip único, mas sim um ciclo de demanda estrutural para toda a cadeia industrial de semicondutores.

Para a indústria de semicondutores,

a verdadeira mudança não é a demanda por GPU, mas sima construção de infraestrutura de poder computacional de longo prazo.

Aviso Legal: o conteúdo deste artigo reflete exclusivamente a opinião do autor e não representa a plataforma. Este artigo não deve servir como referência para a tomada de decisões de investimento.

Talvez também goste

Fato rápido - Principais empresas farmacêuticas competindo para lançar um comprimido para perda de peso

Gap observa oportunidade de recuperação impulsionada pelo clima após queda acentuada de 10%